Последние добавленные видео:

Sparse-Attention

-

![Как внимание стало настолько эффективным [GQA/MLA/DSA]](https://imager.clipsaver.ru/Y-o545eYjXM/max.jpg) 4 месяца назад

74904 4 месяца назад 29:02

4 месяца назад

74904 4 месяца назад 29:02Как внимание стало настолько эффективным [GQA/MLA/DSA]

-

2 недели назад

1379 2 недели назад 18:07

2 недели назад

1379 2 недели назад 18:07Объяснение принципа разреженного внимания DeepSeek: на 80% дешевле ИИ с длинным контекстом

-

6 месяцев назад

2477 6 месяцев назад 15:00

6 месяцев назад

2477 6 месяцев назад 15:00NEW DeepSeek Sparse Attention Explained - DeepSeek V3.2-Exp

-

1 год назад

2236 1 год назад 45:11

1 год назад

2236 1 год назад 45:11Lecture: GPT-3 and Sparse Attention

-

4 года назад

290 4 года назад 6:46

4 года назад

290 4 года назад 6:46Is Sparse Attention more Interpretable?

-

1 год назад

3899992 1 год назад 26:10

1 год назад

3899992 1 год назад 26:10Attention in transformers, step-by-step | Deep Learning Chapter 6

-

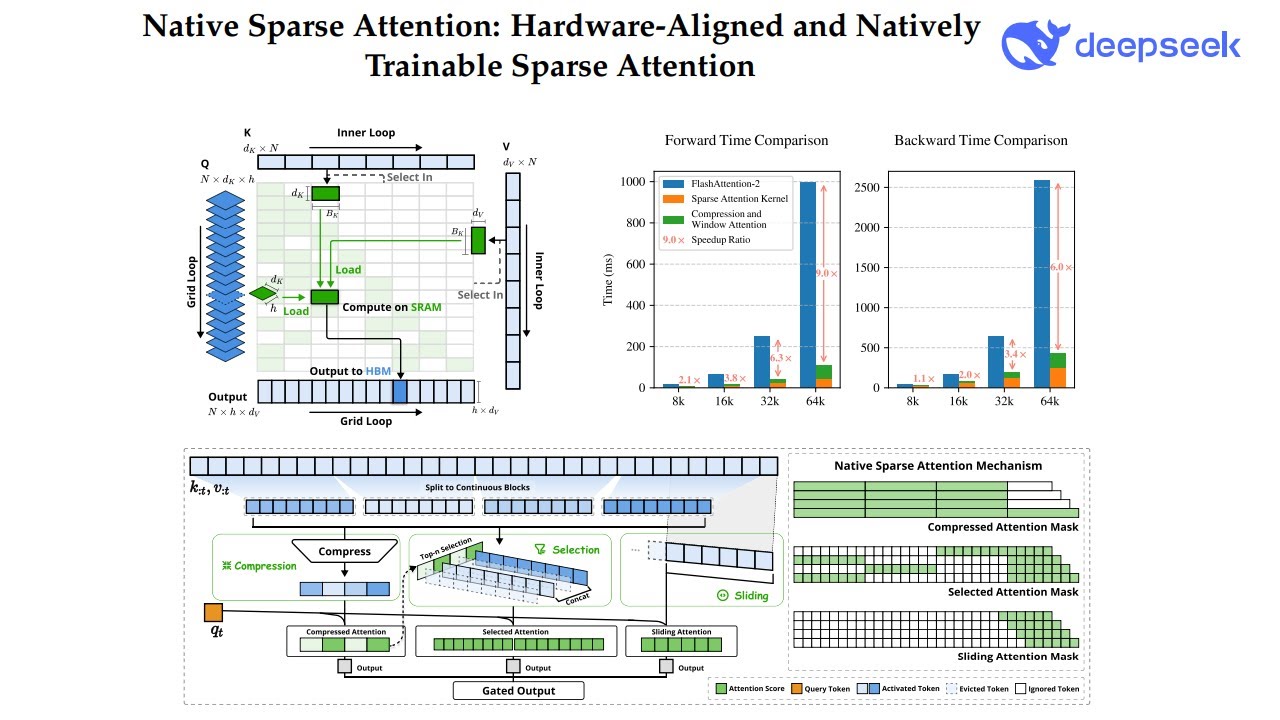

1 год назад

6095 1 год назад 40:08

1 год назад

6095 1 год назад 40:08Native Sparse Attention: Hardware-Aligned and Natively Trainable Sparse Attention

-

5 лет назад

203 5 лет назад 7:17

5 лет назад

203 5 лет назад 7:17Short Intro for HPCA'21 SpAtten: Efficient Sparse Attention Architecture by Hanrui Wang

-

5 месяцев назад

361 5 месяцев назад 17:06

5 месяцев назад

361 5 месяцев назад 17:06#280 Нативная рассеянность внимания от DeepSeek

-

4 месяца назад

74 4 месяца назад 4:23

4 месяца назад

74 4 месяца назад 4:23SSA: Training Better Sparse Attention for LLMs

-

9 дней назад

135 9 дней назад 7:23

9 дней назад

135 9 дней назад 7:23Memory Sparse Attention for Human-Scale AI Lifelong Memory

-

2 года назад

6474 2 года назад 13:17

2 года назад

6474 2 года назад 13:17Sparse LLMs at inference: 6x faster transformers! | DEJAVU paper explained

-

1 месяц назад

95 1 месяц назад 1:42:45

1 месяц назад

95 1 месяц назад 1:42:45Deepseek Sparse Attention

-

2 месяца назад

36 2 месяца назад 4:16

2 месяца назад

36 2 месяца назад 4:16FASA: Sparse Attention for Efficient LLM KV Cache

-

![[Разреженное внимание] Объяснение нативного разреженного внимания (NSA): эффективное моделировани...](https://imager.clipsaver.ru/tlhEN2v28kc/max.jpg) 2 месяца назад

191 2 месяца назад 15:00

2 месяца назад

191 2 месяца назад 15:00[Разреженное внимание] Объяснение нативного разреженного внимания (NSA): эффективное моделировани...

-

![How DeepSeek Rewrote the Transformer [MLA]](https://imager.clipsaver.ru/0VLAoVGf_74/max.jpg) 1 год назад

888476 1 год назад 18:09

1 год назад

888476 1 год назад 18:09How DeepSeek Rewrote the Transformer [MLA]

-

1 год назад

254 1 год назад 8:25

1 год назад

254 1 год назад 8:25Native Sparse Attention Boosts Speed by 6x: Long Text Processing with Large Language Models