Week 7 – Part 1: Attention Mechanisms & Transformer Foundations скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Week 7 – Part 1: Attention Mechanisms & Transformer Foundations в качестве 4k

У нас вы можете посмотреть бесплатно Week 7 – Part 1: Attention Mechanisms & Transformer Foundations или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Week 7 – Part 1: Attention Mechanisms & Transformer Foundations в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Week 7 – Part 1: Attention Mechanisms & Transformer Foundations

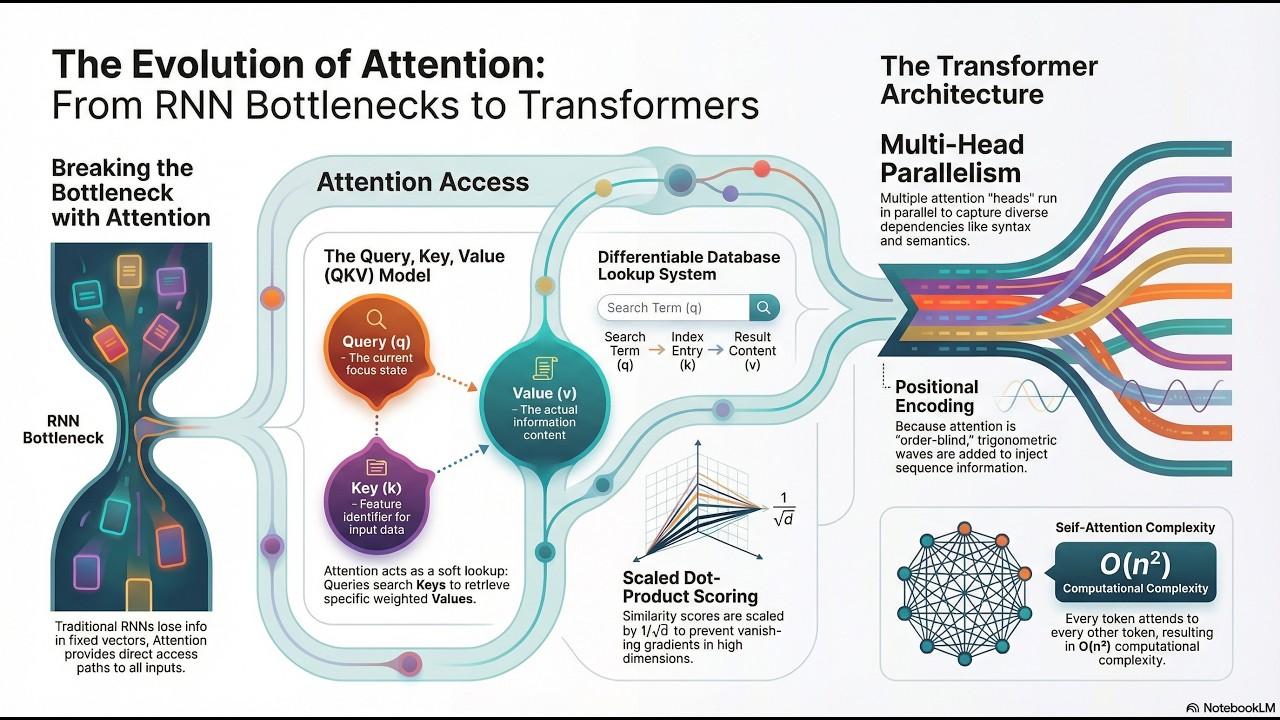

In this lecture, we explore the breakthrough idea that reshaped modern AI: attention mechanisms and the foundation of the Transformer architecture. We begin by examining the limitations of recurrent neural networks (RNNs) and LSTMs, particularly their difficulty modelling long-range dependencies and their inability to parallelise efficiently. From there, we introduce the core mathematical framework behind attention — the Query–Key–Value formulation — and derive the scaled dot-product attention mechanism step by step.