Counterfactual Explanations: The Future of Explainable AI | Aviv Ben Arie скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Counterfactual Explanations: The Future of Explainable AI | Aviv Ben Arie в качестве 4k

У нас вы можете посмотреть бесплатно Counterfactual Explanations: The Future of Explainable AI | Aviv Ben Arie или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Counterfactual Explanations: The Future of Explainable AI | Aviv Ben Arie в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Counterfactual Explanations: The Future of Explainable AI | Aviv Ben Arie

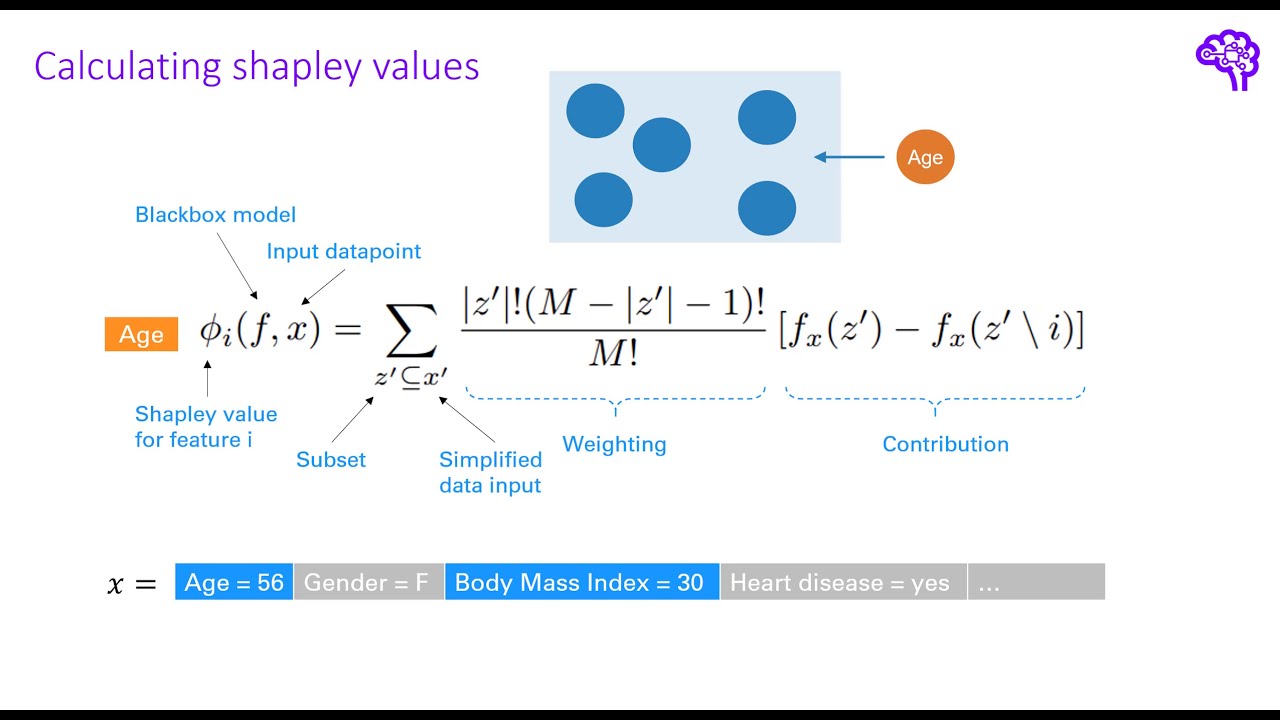

As data scientists, the ability to understand our models’ decisions is important, especially for models that could have a high impact on people’s lives. This may pose several challenges, as most models used in the industry are not inherently explainable. Today, the most popular explainability methods are SHAP (SHapley Additive exPlanations) and LIME (Local Interpretable Model-Agnostic Explanation). Each method offers convenient APIs, backed by solid mathematical foundations, but falls short in intuitiveness and actionability. In this workshop/article, I will introduce a relatively new model explanation method - Counterfactual Explanations (CFs). CFs are explanations based on minimal changes to a model’s input features that lead the model to output a different (mostly opposite) predicted class. CFs have been shown to be more intuitive for humans to comprehend and provide actionable feedback, compared to traditionalSHAP and LIME methods. I will review the challenges in this novel field (such as how to ensure that the CF proposes changes which are feasible), provide a birds-eye view of the latest research and give my perspective, based on my research in collaboration with Tel Aviv University, on the various aspects in which CFs can transform the way data science practitioners understand their ML models. This workshop was conducted by Aviv Ben Arie, Data Science Manager at Intuit Learn more about WiDS Workshops: widsconference.org/workshops #Stanford #Intuit #WiDS #Womenindatascience