Mistral 7B & Mixtral 8x7B Explained — Models, Embeddings, Use Cases, Performance скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Mistral 7B & Mixtral 8x7B Explained — Models, Embeddings, Use Cases, Performance в качестве 4k

У нас вы можете посмотреть бесплатно Mistral 7B & Mixtral 8x7B Explained — Models, Embeddings, Use Cases, Performance или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Mistral 7B & Mixtral 8x7B Explained — Models, Embeddings, Use Cases, Performance в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Mistral 7B & Mixtral 8x7B Explained — Models, Embeddings, Use Cases, Performance

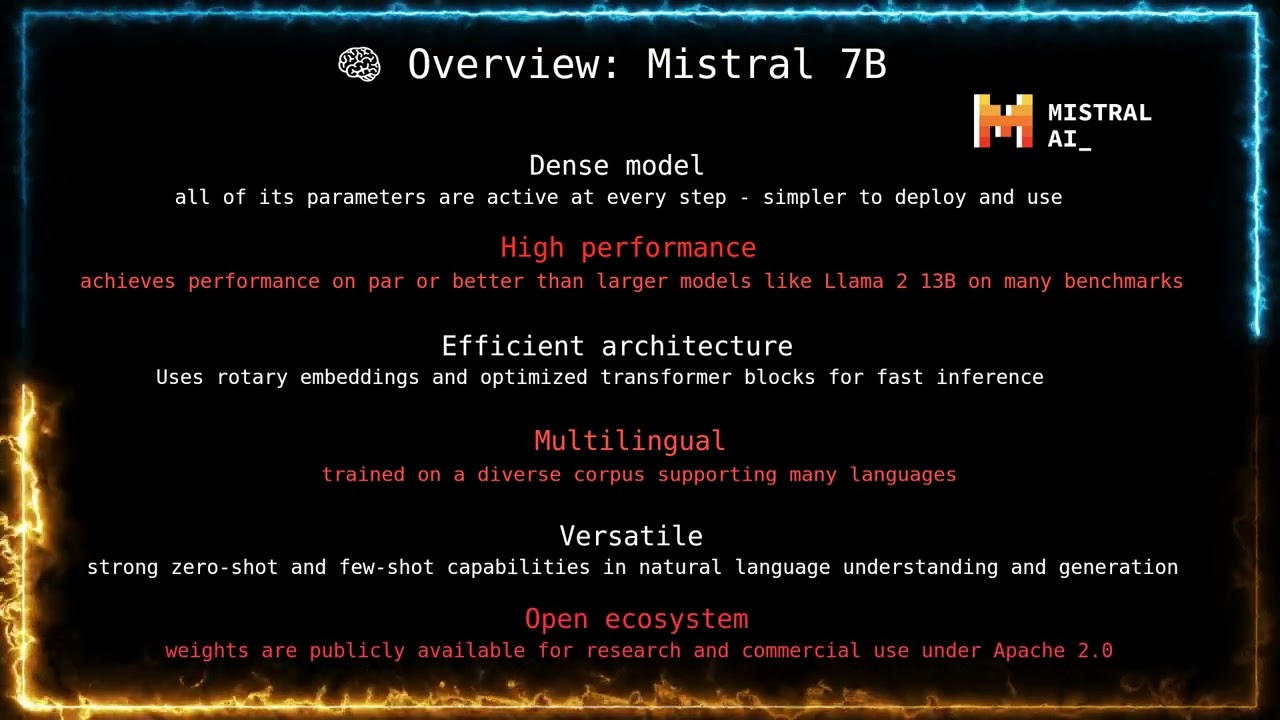

In this video, we explore everything you need to know about Mistral 7B and Mixtral 8x7B — two of the most powerful open-weight language models available today. 🧠 We cover: What is Mistral (the company)? Mistral 7B: architecture, features, and use cases Mixtral 8x7B: how Mixture of Experts works and why it matters Embedding models: What’s available (and not) from Mistral NVIDIA’s NV‑EmbedQA‑Mistral‑7B‑v2 Performance benchmarks and comparisons (GPT-3.5, LLaMA 2, GPT-4 Turbo) 🧪 Use Cases: ✅ RAG (Retrieval-Augmented Generation) ✅ Complex assistants & multilingual agents ✅ Long-context summarization (32K tokens!) ✅ Code generation & more 🚀 Whether you're building AI apps, exploring open-source LLMs, or evaluating alternatives to OpenAI — this is your 2025 guide to Mistral. #Mistral7B #Mixtral8x7B #OpenSourceLLM #MistralAI #AIModels2025 #MixtureOfExperts #RAGpipeline #LangChain #LLMcomparison #AIbenchmarks #CodeGeneration #MultilingualAI #GPT35vsMistral #MistralTutorial #EmbeddingModels 👍 Like, subscribe, and turn on notifications for more LLM and AI deep dives! https://www.cholakovit.com

![Как внимание стало настолько эффективным [GQA/MLA/DSA]](https://imager.clipsaver.ru/Y-o545eYjXM/max.jpg)