Постановка задачи машинного обучения.эмпирический риск.Функционал потерь.Простая Линейная регрессия. скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Постановка задачи машинного обучения.эмпирический риск.Функционал потерь.Простая Линейная регрессия. в качестве 4k

У нас вы можете посмотреть бесплатно Постановка задачи машинного обучения.эмпирический риск.Функционал потерь.Простая Линейная регрессия. или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Постановка задачи машинного обучения.эмпирический риск.Функционал потерь.Простая Линейная регрессия. в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Постановка задачи машинного обучения.эмпирический риск.Функционал потерь.Простая Линейная регрессия.

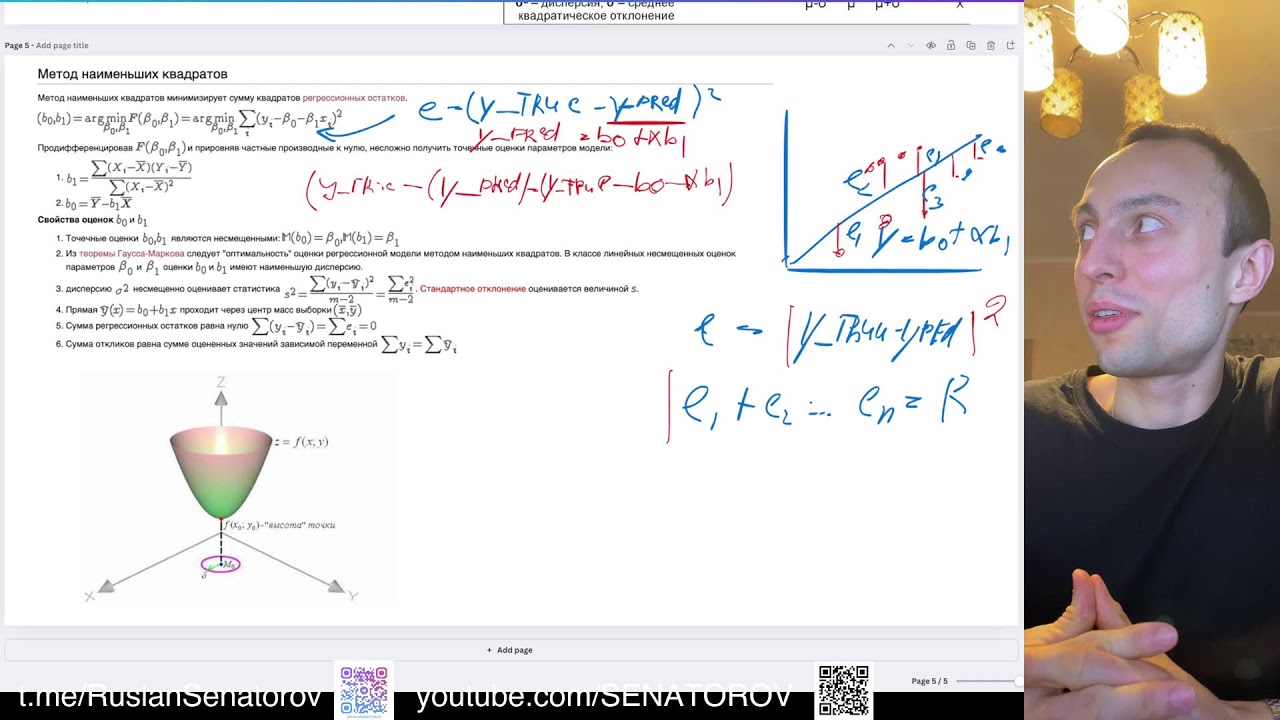

00:00:00 – Постановка задачи: Найти алгоритм, порождающий точки, и определить функцию, описывающую их генерацию. 00:01:16 – Методы поиска функции: Пошаговое увеличение степени полинома и разложение в ряд Тейлора. 00:02:02 – Алгоритм и аппроксимация: Восстановление истинной функции по x через её аппроксимацию. 00:03:00 – Векторная форма: Использование столбцовых векторов для данных и откликов, аппроксимация через функцию y с крышечкой. 00:04:50 – Скалярное произведение: Добавление единичного столбца и применение транспонирования для оптимизации. 00:08:49 – Функция потерь: Введение loss-функции (пример — модель расчёта цены по пройденным милям). 00:13:08 – Оптимизация: Поиск минимума loss-функции (гиперболоид) и подбор оптимального шага. 00:14:40 – Выпуклость и дифференцируемость: Функция выпуклая и дифференцируемая; введение модульной функции как метрики. 00:15:54 – Функционал потерь vs. метрика: Различие между функцией потерь и оценочной метрикой модели. 00:16:53 – MSE vs. MAE: Сравнение: MAE лучше на малых ошибках, MSE эффективнее при больших отклонениях. 00:19:46 – Признаки и типы данных: Обзор различных типов признаков и введение эмпирического риска. 00:21:35 – Эмпирический риск: Среднее значение loss-функции по обучающему набору для обновления весов. 00:24:05 – Градиент и спуск: Введение градиента как направления наибольшего роста и его использования для оптимизации. 00:25:32 – Градиент: Вектор частных производных, указывающий направление максимального увеличения функции. 00:26:56 – Антиградиент: Использование отрицательного градиента для спуска к минимуму. 00:27:07 – Частные производные: Определение касательных в точке для функций нескольких переменных. 00:28:25 – Пример loss-функции: 3D-параболическая форма сечением, дающим 2D-кривую. 00:29:38 – Геометрия производных: Сечение многомерной функции для получения 2D-представления и вычисления частных производных. 00:31:23 – Локальные и глобальные точки: Определение локальных минимумов и поиск глобального минимума с помощью гиперпараметра (шага). 00:33:19 – Экстремумы: Минимумы и максимумы, использование второй производной для определения выпуклости. 00:34:52 – Заключение: Анонс следующего урока по достижению минимума функции (производная, предел, шаг) и пожелания здоровья. 🚀 Вступай в сообщество: https://boosty.to/SENATOROV 🍑 Подписывайся на Telegram: https://t.me/RuslanSenatorov 🔥 Начни работать с криптовалютой на Bybit: https://www.bybit.com/invite?ref=MAN2VD 💰 Донат: https://www.donationalerts.com/c/sena... 💰 Стать спонсором : (USDT TRC20) TPWP9kuqqetDNPeLjAe51F1i2jPxwYYBDu (USDT BEP20) 0xf3db7ce90a55d1d25b7a6d1ded811fb2a7523f3d Основные математические темы: Математический анализ: Пределы и непрерывность Производные и частные производные Градиенты и оптимизация Интегралы Оптимизация функций Теорема о среднем значении Многомерный анализ Теория вероятностей: Случайные величины Распределения вероятностей (нормальное, биномиальное, пуассоновское) Условная вероятность Теорема Байеса Законы больших чисел и центральная предельная теорема Статистика: Математическое ожидание, дисперсия Статистические гипотезы и критерии Регрессия и корреляция Оценки параметров (метод максимального правдоподобия, метод наименьших квадратов) Анализ данных и визуализация Описательная статистика Интервальная оценка Проверка гипотез Регрессионный анализ Теги: Математика для машинного обучения, Линейная алгебра в Data Science, Математический анализ для машинного обучения, Теория вероятностей и статистика, Математика для анализа данных, Векторы и матрицы, Производные и градиенты, Распределения вероятностей, Регрессия и корреляция, Машинное обучение, Data Science обучение, Математические основы ML, Алгоритмы машинного обучения, линейная алгебра для машинного обучения, теория вероятностей в data science, математический анализ в ML, статистика для анализа данных, data science с нуля, машинное обучение для начинающих, Python для data science, R для анализа данных, numpy, pandas, scikit-learn, deep learning, нейронные сети, искусственный интеллект, #математика #datascience #machinelearning математика с нуля, математика для дата сайнс, математика для машинного обучения, математика для чайников, математика для начинающих, математика для программистов, математика для data science, репетитор по математике, преподаватель по математике, учитель по математике, учитель математики, ментор по математике, тичер по математике, репетитор по дата сайнс с нуля, репетитор по высшей математике, репетитор по математике для взрослых, математика для заочников математика для дата аналитика