F4_DATA_ENGINEER 8: Créer pipeline Data Engineering : ETL sous GCP avec Apache Beam скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: F4_DATA_ENGINEER 8: Créer pipeline Data Engineering : ETL sous GCP avec Apache Beam в качестве 4k

У нас вы можете посмотреть бесплатно F4_DATA_ENGINEER 8: Créer pipeline Data Engineering : ETL sous GCP avec Apache Beam или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон F4_DATA_ENGINEER 8: Créer pipeline Data Engineering : ETL sous GCP avec Apache Beam в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

F4_DATA_ENGINEER 8: Créer pipeline Data Engineering : ETL sous GCP avec Apache Beam

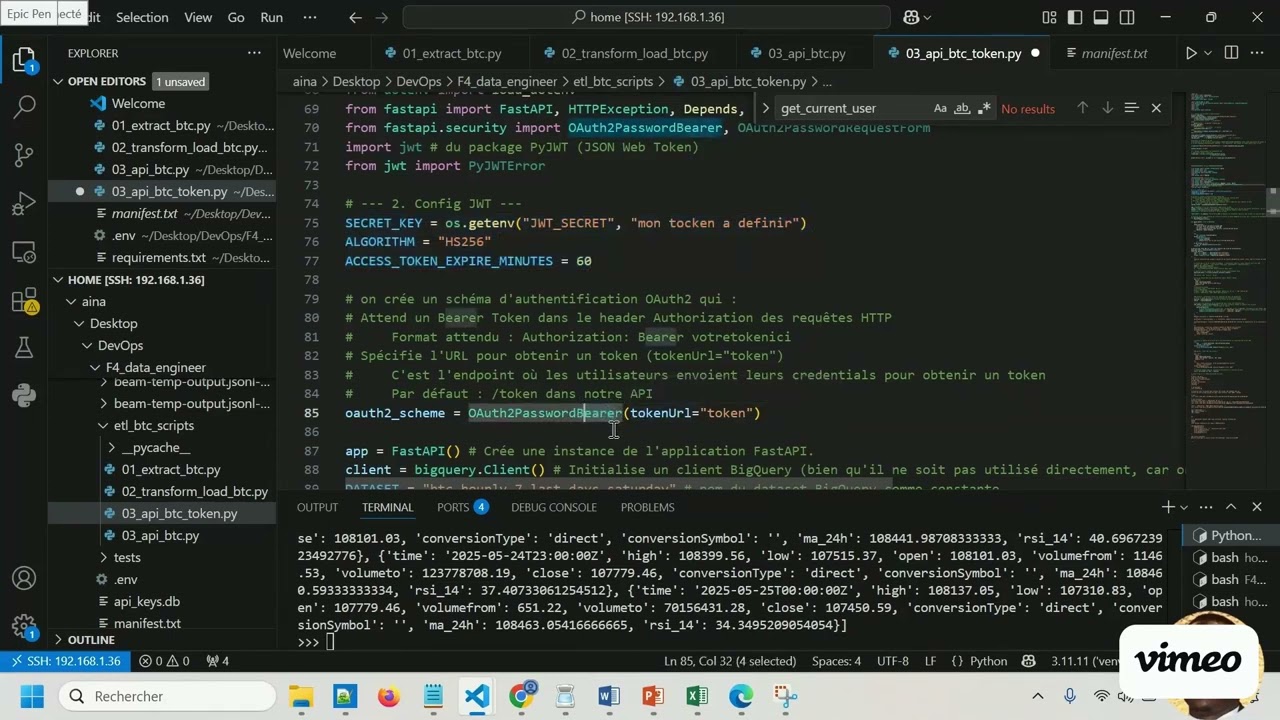

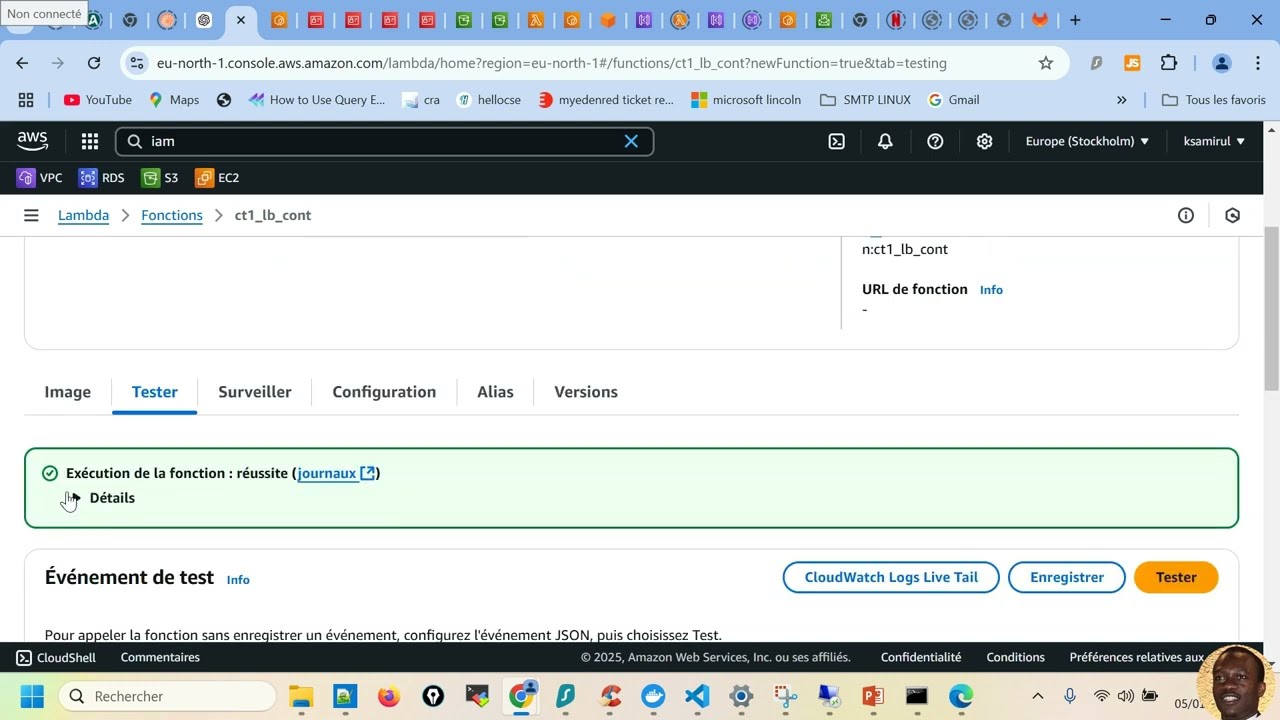

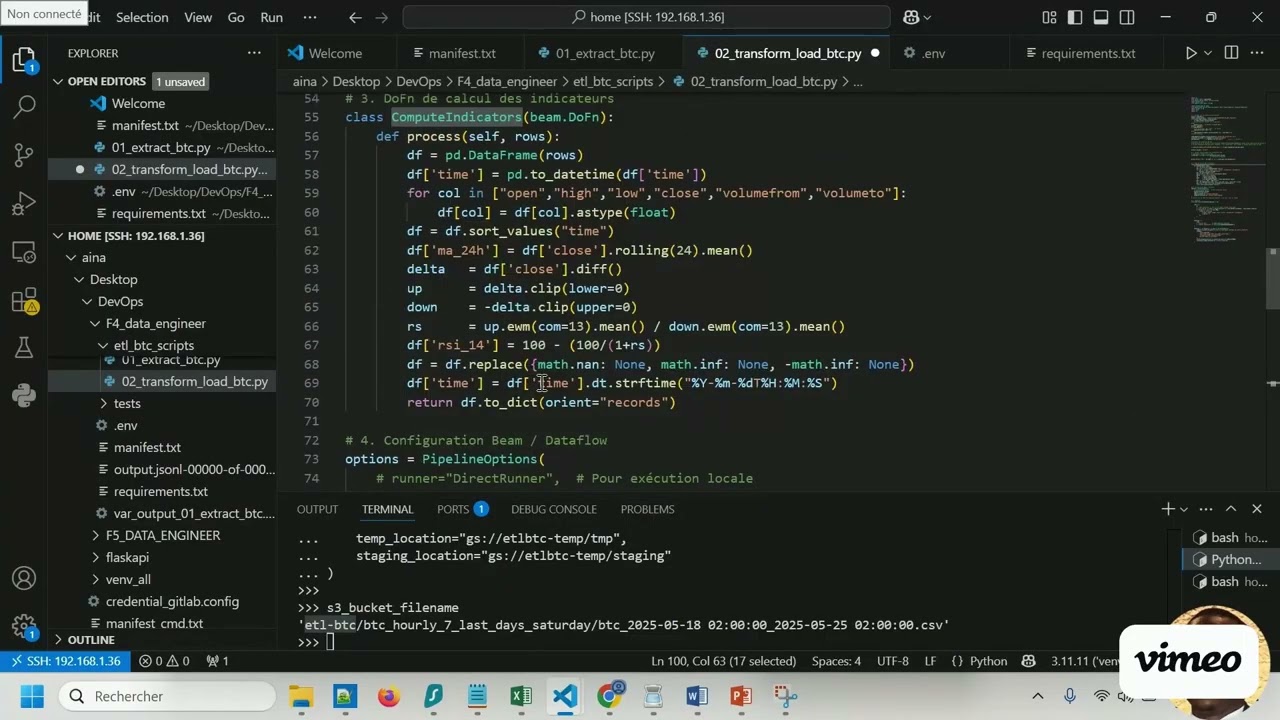

Dans cette vidéo, je te montre pas à pas comment construire un pipeline complet de data engineering avec Apache Beam, de l’extraction de données depuis S3 à leur transformation et export vers BigQuery sur Google Cloud Platform. Tu apprendras à : Configurer tes credentials GCP et te connecter à ton projet Préparer un bucket de stockage Cloud pour les fichiers temporaires Extraire et charger des données CSV depuis S3 en ignorant les en-têtes Transformer tes données (création de features, ajout de nouveaux indicateurs type MA et RSI) Exporter efficacement tes données transformées vers BigQuery en définissant le schéma adapté Travailler localement avec un échantillon de données pour calibrer tes fonctions de transformation sans surcharger ta RAM Optimiser le pipeline pour traiter de gros volumes tout en gardant un process industrialisable 💡 Bonnes pratiques partagées : Toujours tester et calibrer les fonctions de transformation sur un échantillon Bien définir les formats de colonnes pour BigQuery Ne pas exporter l’intégralité de la data locale quand elle est volumineuse 👉 Abonne-toi à iTech14 pour devenir un pro du Data Engineering, DevOps, MLOps, Cloud et IA ! 📌 Tous les tutoriels pratiques sont sur itech14.com #ApacheBeam #GCP #BigQuery #DataEngineering #ETL #Cloud #Python #MLOps #DataPipeline