The Scale Up Ethernet SUE Framework for AI ML Accelerators скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: The Scale Up Ethernet SUE Framework for AI ML Accelerators в качестве 4k

У нас вы можете посмотреть бесплатно The Scale Up Ethernet SUE Framework for AI ML Accelerators или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон The Scale Up Ethernet SUE Framework for AI ML Accelerators в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

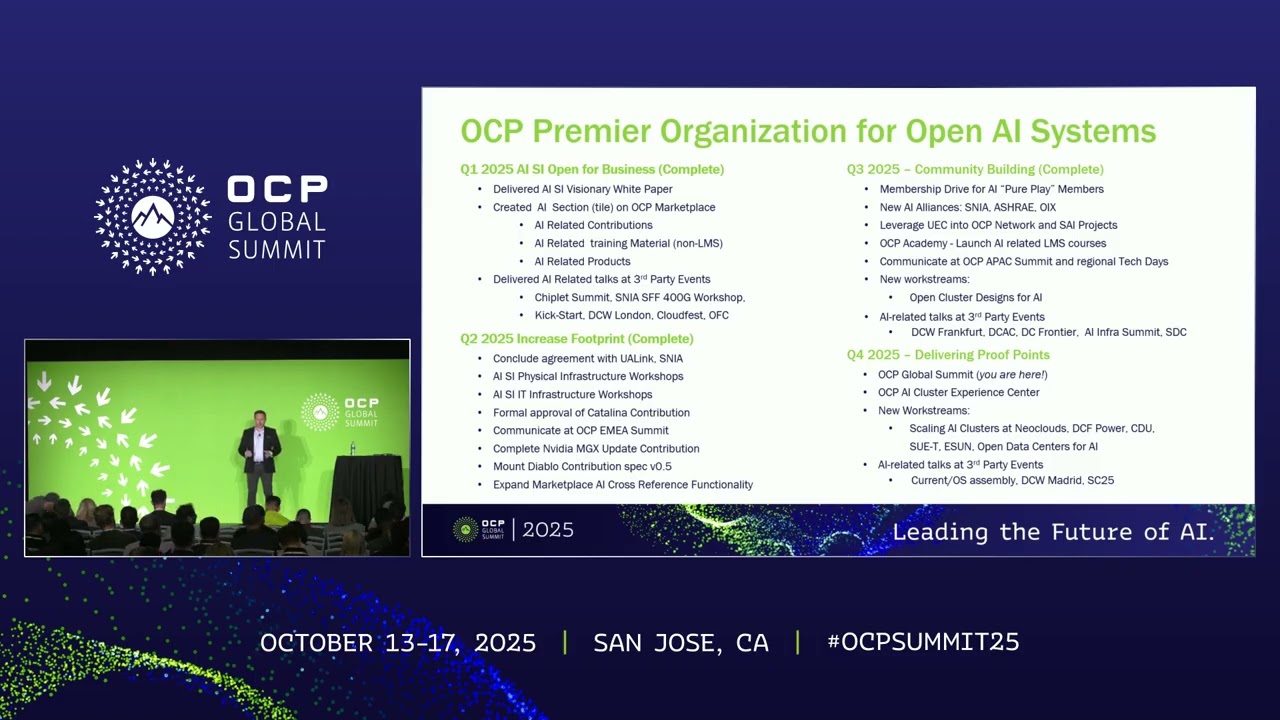

The Scale Up Ethernet SUE Framework for AI ML Accelerators

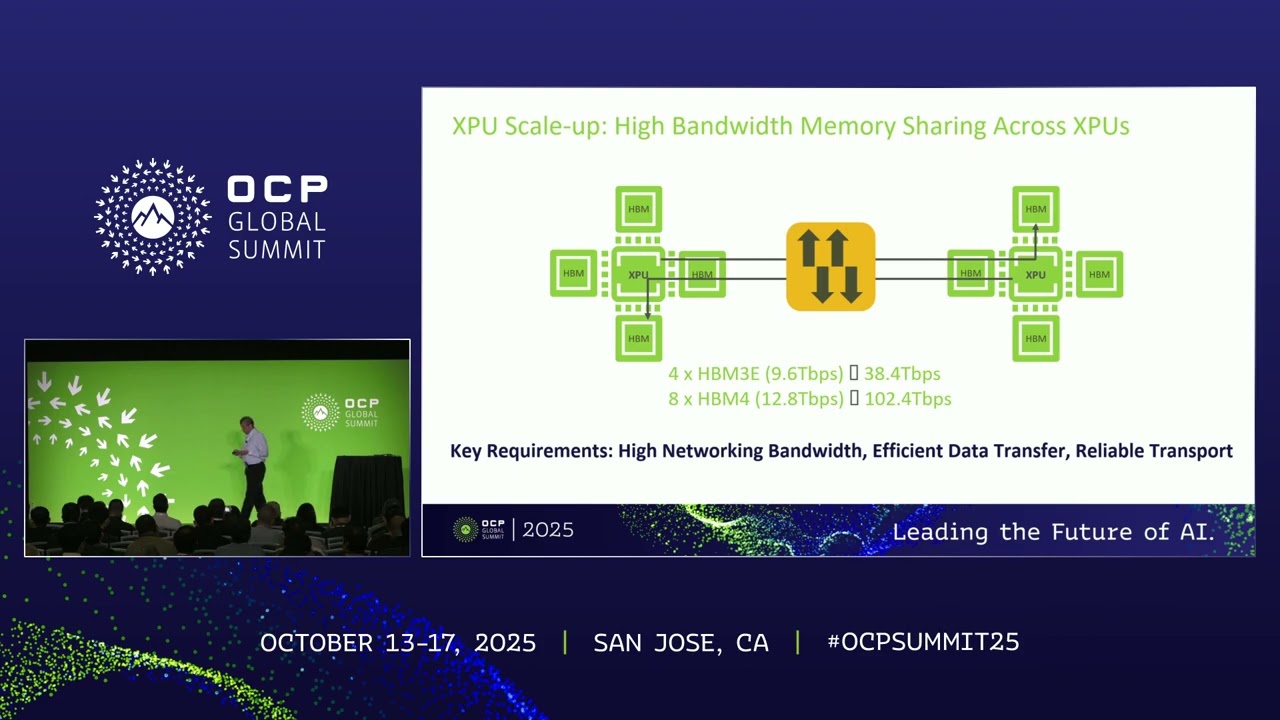

Mohan Kalkunte - , Hugh Holbrook Chief Development Officer - Arista Networks AI-ML workloads in Scale-Up networks require low latency, high bandwidth, lossless communication across tightly-coupled XPU clusters. Traditional network interfaces are area-intensive and limit scalability. The OCP-contributed Scale-Up Ethernet (SUE) Framework is an Ethernet-based AI-ML architecture designed for efficient implementation. SUE standardizes a memory semantics XPU interface and enables a lightweight transport, leveraging AI Forwarding Headers (AFH), Credit-Based Flow Control (CBFC), and Link Layer Retry (LLR) to ensure deterministic performance and low tail latency. Aligned with OCPs mission of open infrastructure, SUE enables scale-up clusters to use merchant Ethernet silicon and open protocols. SUE is seamlessly supported by open OSes such as SONiC. In this session, we present how the SUE framework enables efficient scale-up interconnects for AI-ML clusters, simplifies deployment, and advances the vision of open, Ethernet-based Scale-Up AI.