Positional Encoding in Transformers Explained | Deep Learning скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Positional Encoding in Transformers Explained | Deep Learning в качестве 4k

У нас вы можете посмотреть бесплатно Positional Encoding in Transformers Explained | Deep Learning или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Positional Encoding in Transformers Explained | Deep Learning в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Positional Encoding in Transformers Explained | Deep Learning

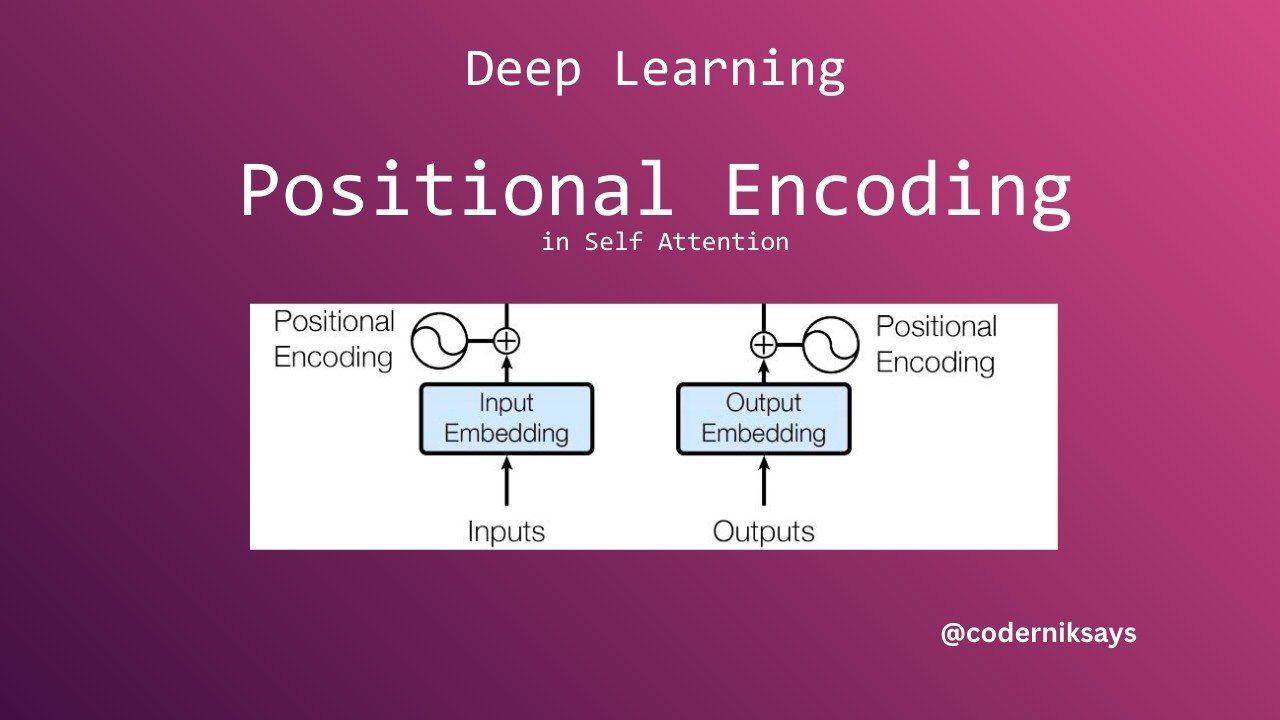

This video provides a comprehensive and intuition-driven explanation of Positional Encoding in Transformers. We begin by analyzing a fundamental limitation of self attention. We rigorously explore: Why self-attention fails without positional encoding Simple positional strategies and their limitations The design motivation behind sinusoidal encoding Why sine and cosine functions were chosen How sinusoidal encoding encodes relative positional differences This is a complete deep dive — conceptually and mathematically. If you want to truly understand Transformers instead of memorizing formulas, this video is for you. Keywords: positional encoding deep explanation, transformer positional encoding intuition, self attention permutation invariance, sinusoidal encoding relative position, attention mechanism deep learning, NLP transformer tutorial #PositionalEncoding #Transformers #DeepLearning #SelfAttention #MachineLearning

![Почему взрываются батарейки и аккумуляторы? [Veritasium]](https://imager.clipsaver.ru/a3-3R9zwyGY/max.jpg)