In pursuit of responsible AI: Bringing principles to practice скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: In pursuit of responsible AI: Bringing principles to practice в качестве 4k

У нас вы можете посмотреть бесплатно In pursuit of responsible AI: Bringing principles to practice или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон In pursuit of responsible AI: Bringing principles to practice в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

In pursuit of responsible AI: Bringing principles to practice

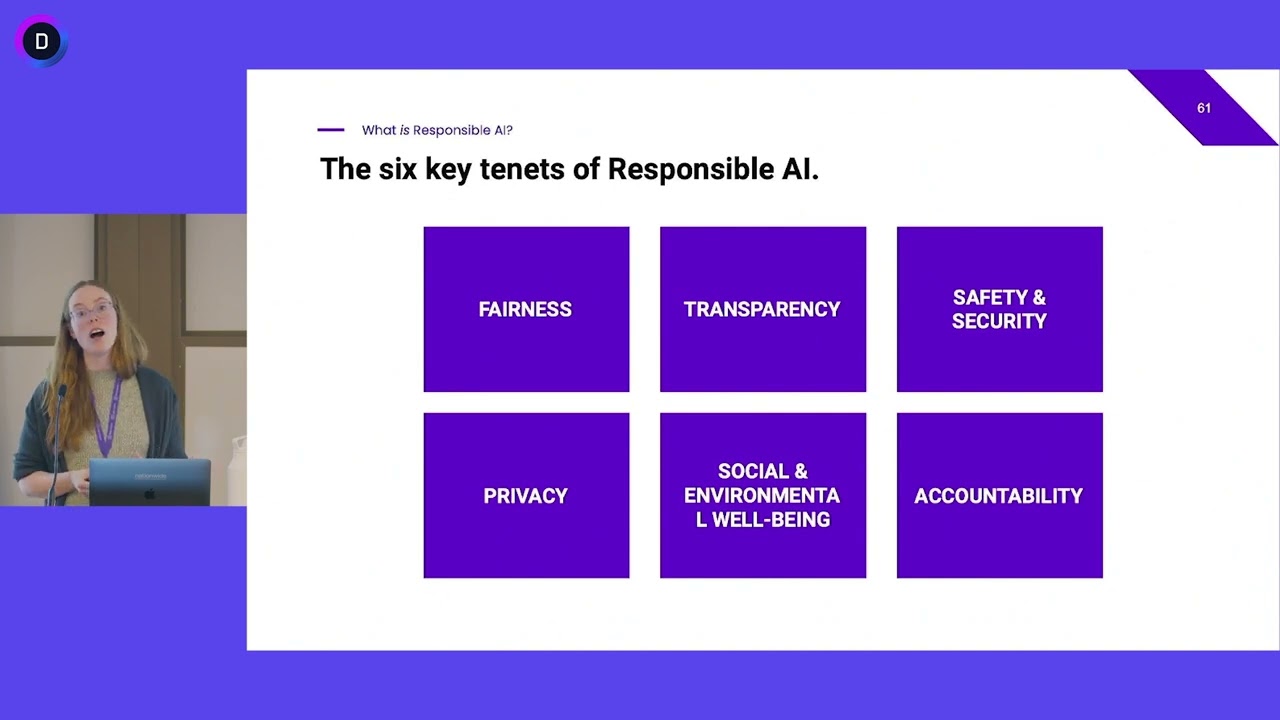

As AI is becoming part of user-facing applications and is directly impacting society, deploying AI reliably and responsibly has become a priority for Microsoft and several other industry leaders. In recent years, Microsoft has developed a set of AI principles and standards alongside a company-wide ecosystem to guide responsible AI development and deployment. In this webinar, Microsoft researchers Dr. Besmira Nushi and Dr. Ece Kamar will share crucial learnings gained from founding and implementing such principles in practice in a large industry setting, where investments in AI span from automation to enhanced human productivity and augmentation. The webinar will present examples of how these learnings are shaping our research on developing principles and tools for bringing the AI principle of reliability and safety to reality. In particular, it will showcase an ecosystem of open-source tools that are intended to accelerate the machine learning (ML) development life cycle by identifying and mitigating failures in a faster, systematic, and rigorous way. These efforts to develop tools are guided by the observation that aggregate metrics are not sufficient to evaluate AI reliability; we need deeper insights into detailed model performance. The discussion will conclude by giving a glimpse into our long-term vision for empowering AI developers with integrated responsible AI tools covering the complete AI life cycle. Together, you will explore: ■ Error Analysis—a tool for identifying and diagnosing failure modes of an individual ML model. Diagnosis is supported either via interactive data explorations or via model explanations based on interpretability techniques provided in InterpretML. ■ BackwardCompatibilityML—a tool for expanding these insights to the scenario of model updates, helping engineers make informed decisions about which model to select for deployment while taking into account regions in which an updated model progresses and regresses. 𝗥𝗲𝘀𝗼𝘂𝗿𝗰𝗲 𝗹𝗶𝘀𝘁: ■ Error Analysis Tool: https://erroranalysis.ai ■ BackwardCompatibilityML tool (GitHub) : https://github.com/microsoft/backward... ■ Error Analysis (Azure Blog): https://techcommunity.microsoft.com/t... ■ BackwardCompatibilityML (Microsoft Research Blog): https://www.microsoft.com/en-us/resea... ■ Towards Accountable AI: (Paper): https://www.microsoft.com/en-us/resea... ■ Responsible AI Resources (Project page): https://www.microsoft.com/en-us/ai/re... ■ Ece Kamar (Researcher Profile): https://www.microsoft.com/en-us/resea... ■ Besmira Nushi (Researcher Profile): https://www.microsoft.com/en-us/resea... *This on-demand webinar features a previously recorded Q&A session and open captioning. Explore more Microsoft Research webinars: https://aka.ms/msrwebinars