TorchServe CPP Backend скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: TorchServe CPP Backend в качестве 4k

У нас вы можете посмотреть бесплатно TorchServe CPP Backend или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон TorchServe CPP Backend в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

TorchServe CPP Backend

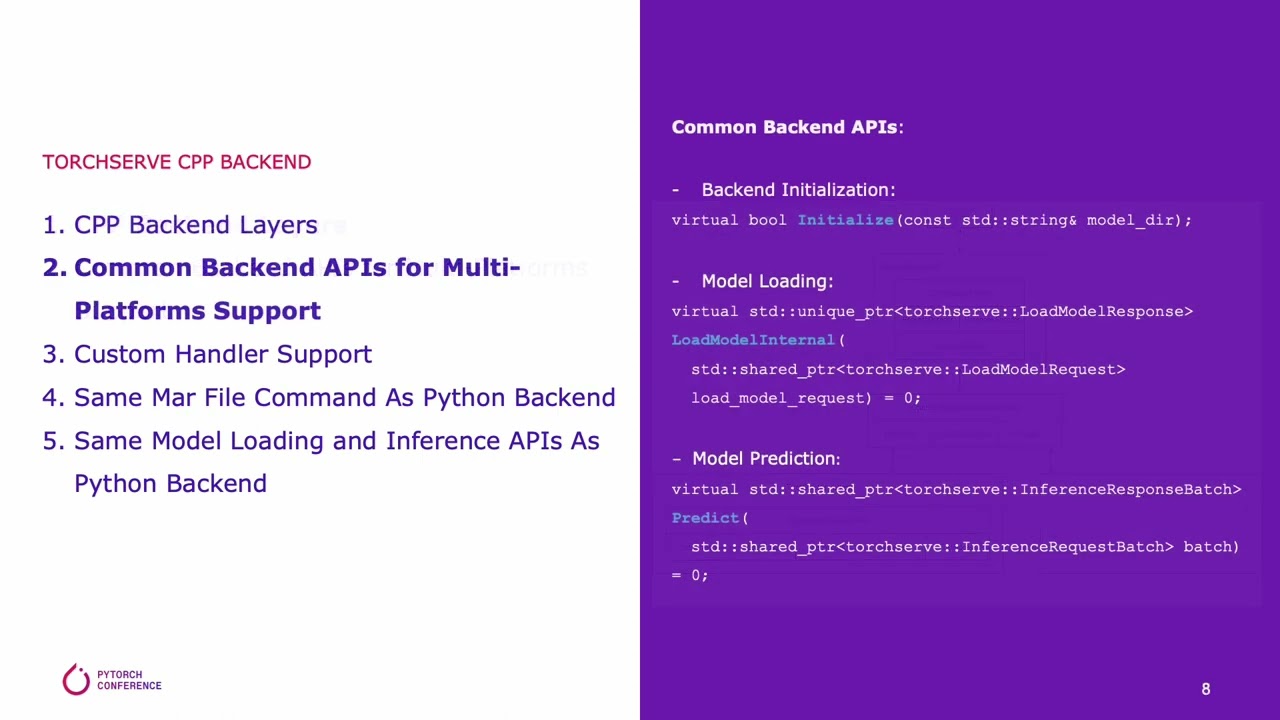

Watch Li Ning from AWS present her talk "TorchServe CPP Backend" at PyTorch Conference 2022. TorchServe is a PyTorch model serving solution. Internally, it is divided into two parts: frontend for model management, and backend for model loading and prediction. TorchServe’s default Python backend allows users to easily plug in a model’s pre and post processing, and also serves PyTorch’s eager mode and torchscripted models. However, this backend limits TorchServe to further performance optimizations due to Python’s restrictions. TorchServe’s CPP backend is a new feature implemented in C++. It not only allows users to plug in model pre and post processing as Python backend does, but also builds the foundation for GPU utilization and concurrency optimization, even providing the flexibility to be embedded in an edge device. Visit our website: https://pytorch.org/ Read our blog: https://pytorch.org/blog/ Follow us on Twitter: / pytorch Follow us on LinkedIn: / pyto. . Follow us on Facebook: / pytorch #PyTorch #ArtificialIntelligence #MachineLearning