Хотите запускать ИИ-агентов локально? Вот минимальный набор необходимых настроек/сборок. скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Хотите запускать ИИ-агентов локально? Вот минимальный набор необходимых настроек/сборок. в качестве 4k

У нас вы можете посмотреть бесплатно Хотите запускать ИИ-агентов локально? Вот минимальный набор необходимых настроек/сборок. или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Хотите запускать ИИ-агентов локально? Вот минимальный набор необходимых настроек/сборок. в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

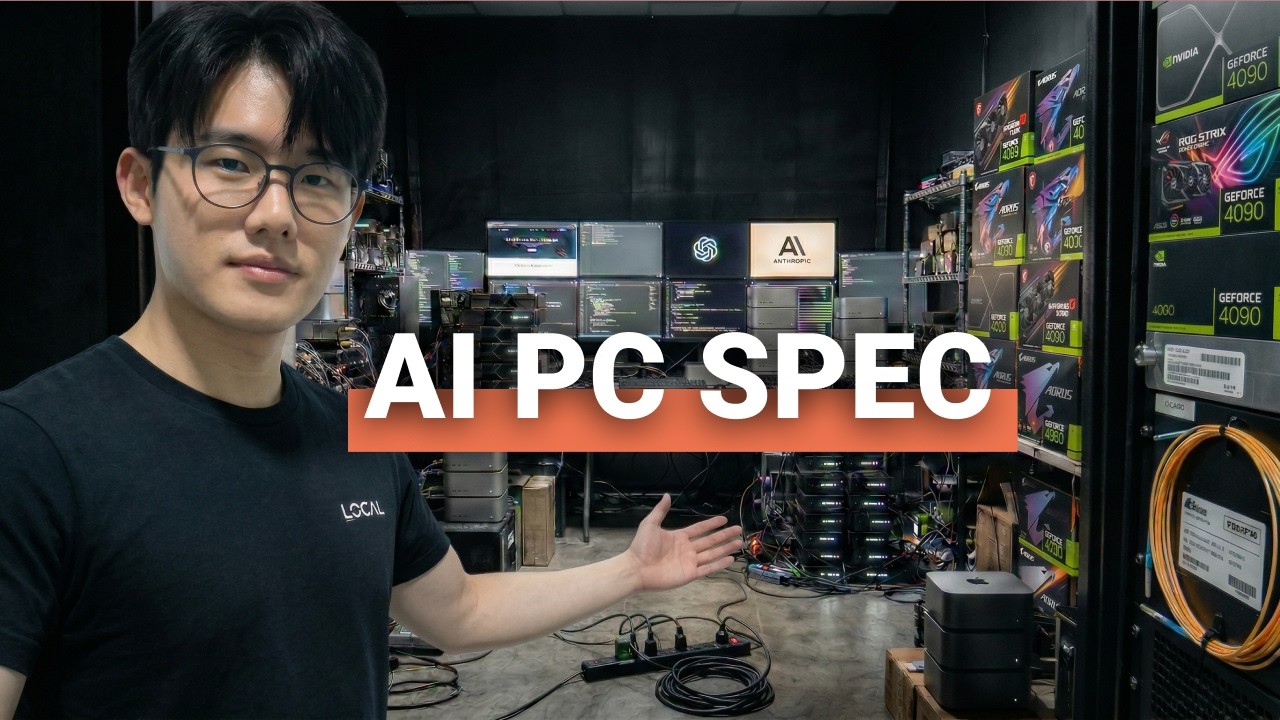

Хотите запускать ИИ-агентов локально? Вот минимальный набор необходимых настроек/сборок.

Получите руководство по сборке ПК для ИИ здесь: https://danieljindoo.substack.com Сборка мощного ПК для локальных агентов ИИ требует иного подхода, чем типичная игровая конфигурация. Мы сосредоточимся на конкретном оборудовании, особенно на видеопамяти (VRAM) видеокарты, которая имеет решающее значение для эффективной работы локальной LLM. Это видео покажет вам, как собрать ПК, оптимизированный для ИИ, с акцентом на такие компоненты, как RTX 4060 Ti с 16 ГБ видеопамяти, и как использовать Ollama для работы с ИИ через командную строку. Забудьте о моделях на основе облачных вычислений; откройте для себя возможности собственной сборки ПК. VRAM — это самая важная характеристика для любой локальной сборки ПК для ИИ, и большинство людей покупают не ту видеокарту именно из-за этого. В этом видео я подробно расскажу о необходимом оборудовании в 3 бюджетных категориях (от 1200 до 5000 долларов и выше) для запуска таких моделей, как Qwen3, DeepSeek R1 и Llama, локально с помощью Ollama, охватывая как ПК, так и Mac варианты. Я также расскажу о том, какие форматы моделей использовать (GGUF против AWQ), как работает квантизация и почему локальный ИИ — это лучшее решение для обеспечения конфиденциальности, контроля затрат и бесперебойной работы в 2026 году. Независимо от того, используете ли вы ИИ-помощников в программировании, анализе документов или создании рабочих процессов агентов с помощью n8n, это руководство покажет вам, что именно стоит покупать, а что лучше пропустить. Временные метки: 00:00 Самая важная характеристика GPU 00:30 Объяснение VRAM: аналогия с кухонной столешницей 01:02 Что происходит при локальном запуске ИИ 02:09 Как 4-битное квантование уменьшает модели ИИ 02:30 Шпаргалка по VRAM: размер модели в ГБ 03:27 Сборка первого уровня: стартовый набор за 1200-1500 долларов 05:12 Mac против PC для локального ИИ: унифицированная память 06:48 Сборка второго уровня: серьезный набор за 2000-3500 долларов 09:14 Сборка третьего уровня: режим "зверя" за 3500-5000+ долларов 11:00 RTX 5090 и двухпроцессорные конфигурации 11:21 Можно ли запустить ИИ на Raspberry Pi? 11:59 Ollama против LM Studio: что выбрать 12:49 GGUF против AWQ: выбор правильного формата модели 13:52 Локальный ИИ против облачного ИИ: честное сравнение 15:42 Резюме: что купить при любом бюджете #LocalAI #AIBuild #VRAM НАЙДИТЕ МЕНЯ В СОЦИАЛЬНЫХ СЕТЯХ X/Twitter: / https://x.com/Jdaniel1216_ Instagram: / / jinni_doo LinkedIn: / / hyoungjin-doo-a19394238 Веб-сайт: / https://doomade.com/