Gradient Descent Explained Simply: How AI Models Actually Learn скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Gradient Descent Explained Simply: How AI Models Actually Learn в качестве 4k

У нас вы можете посмотреть бесплатно Gradient Descent Explained Simply: How AI Models Actually Learn или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Gradient Descent Explained Simply: How AI Models Actually Learn в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Gradient Descent Explained Simply: How AI Models Actually Learn

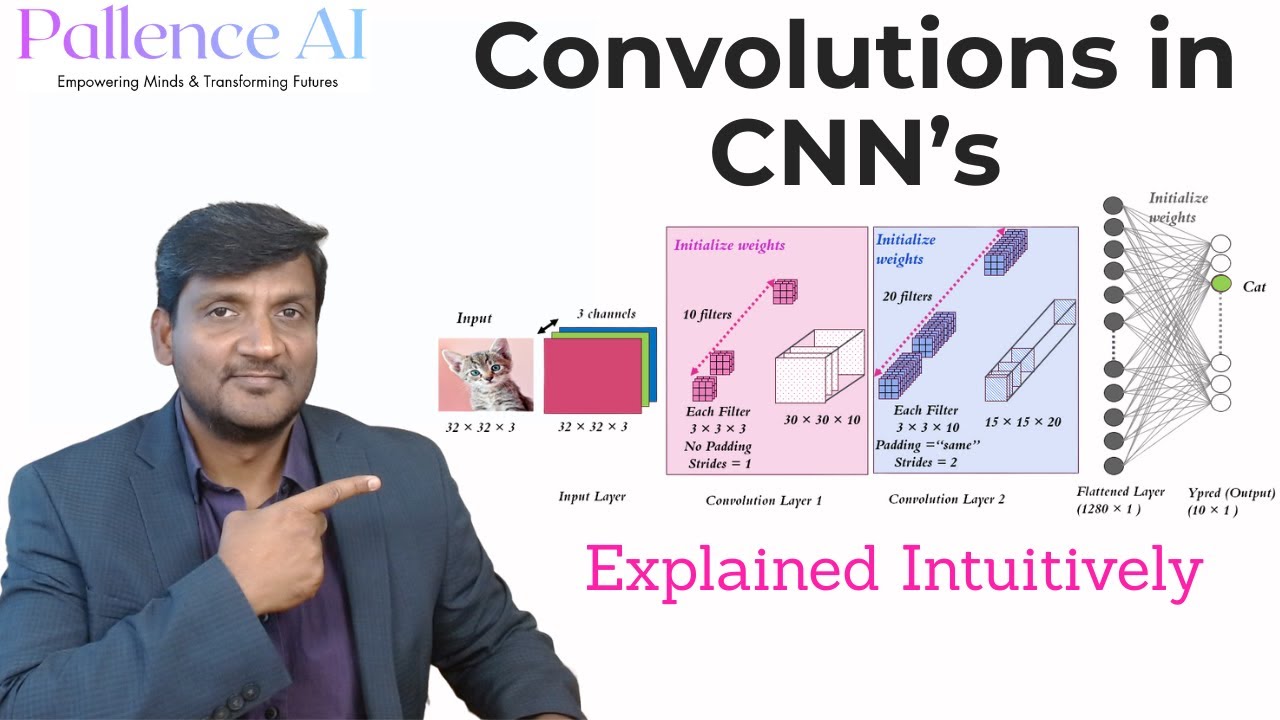

▶ Deep Learning Foundations Playlist (start here): • What is Artificial Intelligence, Machine L... In this video, I break down Gradient Descent — the core idea behind how neural networks actually learn. You’ve probably heard terms like optimizer, loss, learning rate, SGD, Adam… but what do they really mean? Here’s the simple explanation: A model starts with random weights, measures how wrong it is (loss), and then uses gradient descent to update weights step-by-step toward better predictions. In this lesson, you’ll understand: What gradient descent is (intuition-first) Why the learning rate matters (too small vs too big) Why different optimizers exist (SGD, Momentum, RMSProp, Adam) This is part of my Deep Learning Foundations series, designed to make AI concepts feel clear, approachable and intuitive. If this helped you, consider subscribing — I’m building this channel to help you understand AI concepts clearly, not just use AI on a high level. Full Course (Deep Learning Mastery on Udemy): https://www.udemy.com/course/deep-lea...

![Python For Data Science Full Course 2026 [FREE] | Applied Data Science With Python | Simplilearn](https://imager.clipsaver.ru/uegZ_cy5zDA/max.jpg)

![Best of Deep House [2026] | Melodic House & Progressive Flow](https://imager.clipsaver.ru/Il-ZpBuC8tA/max.jpg)