Bellman equation | Bellman Backup | Optimal Value | Value Iteration | MDP скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Bellman equation | Bellman Backup | Optimal Value | Value Iteration | MDP в качестве 4k

У нас вы можете посмотреть бесплатно Bellman equation | Bellman Backup | Optimal Value | Value Iteration | MDP или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Bellman equation | Bellman Backup | Optimal Value | Value Iteration | MDP в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Bellman equation | Bellman Backup | Optimal Value | Value Iteration | MDP

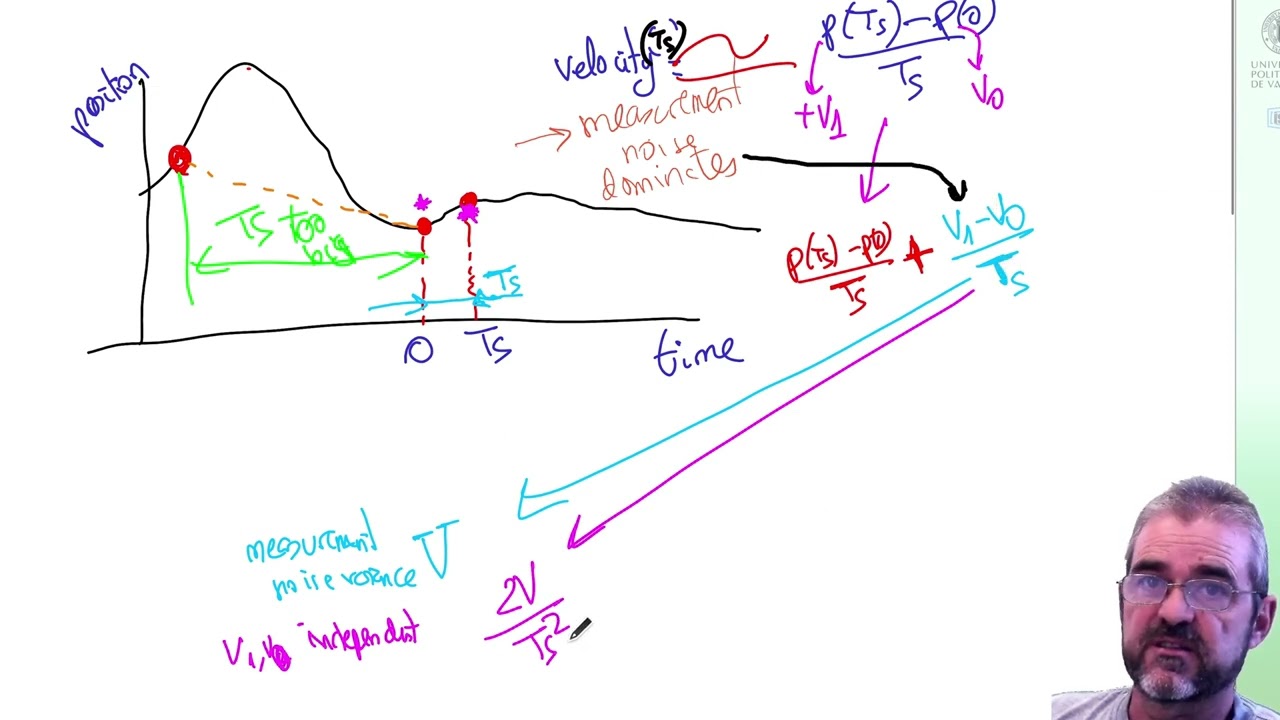

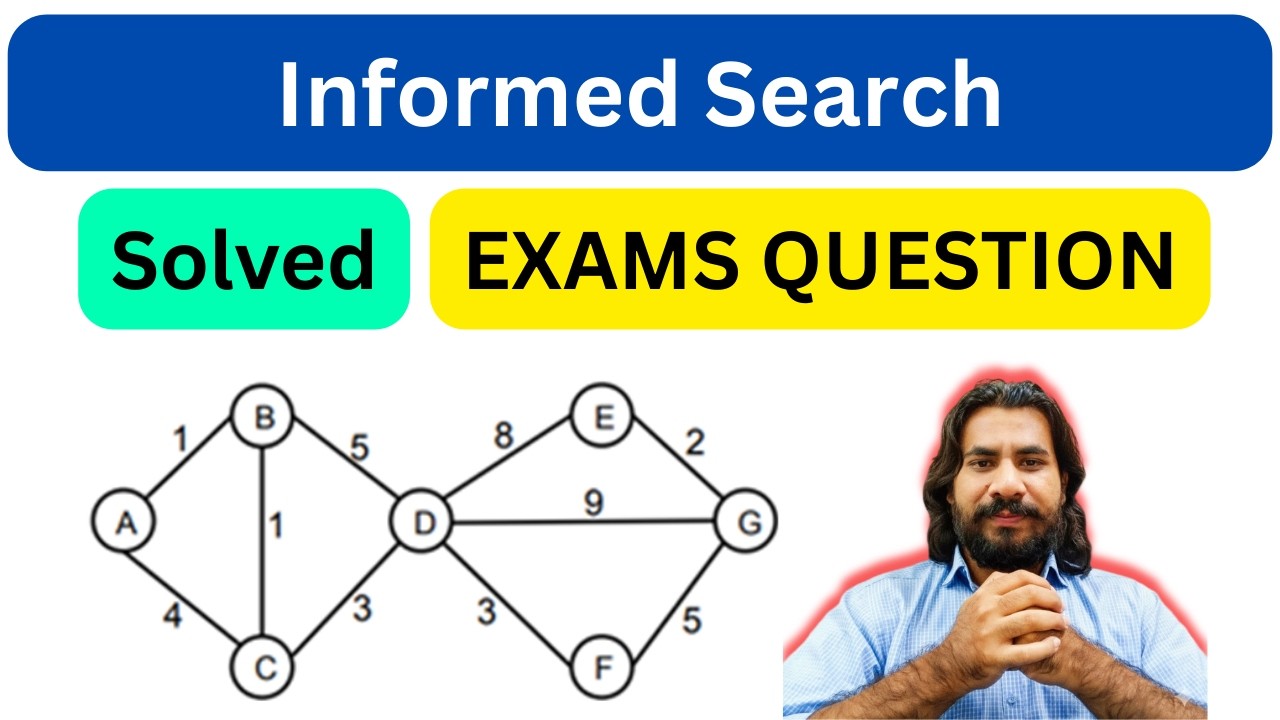

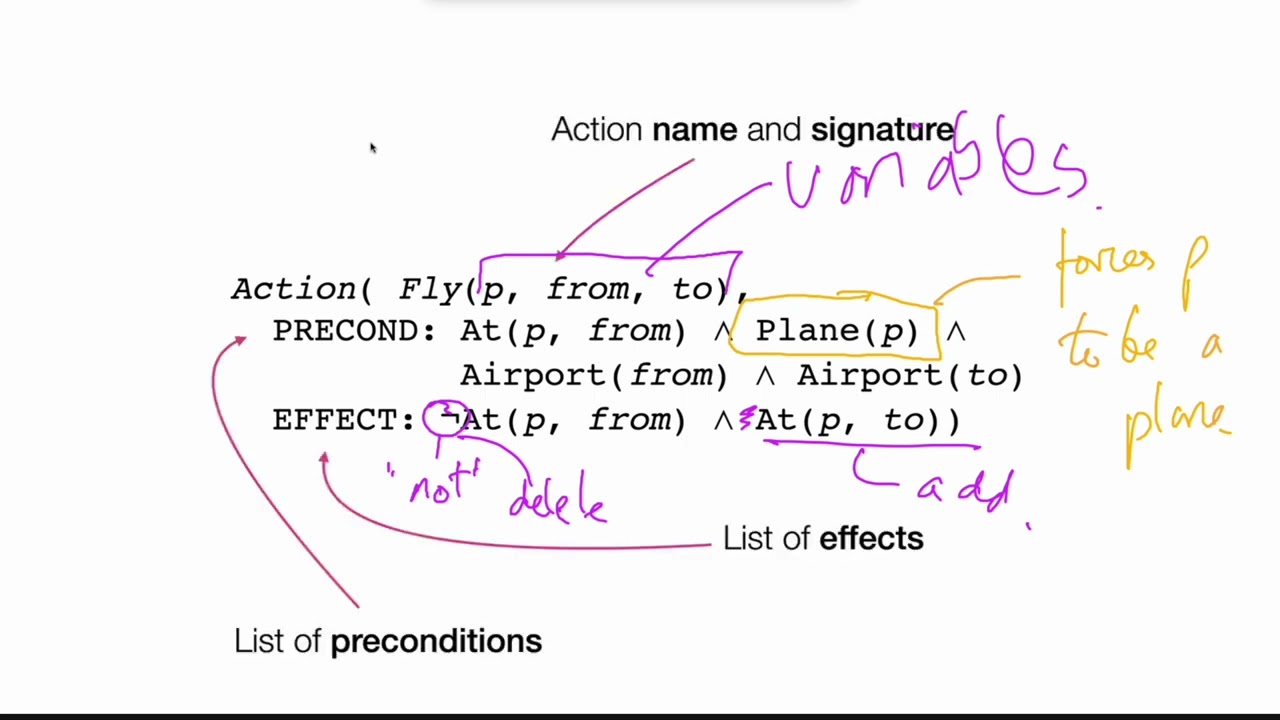

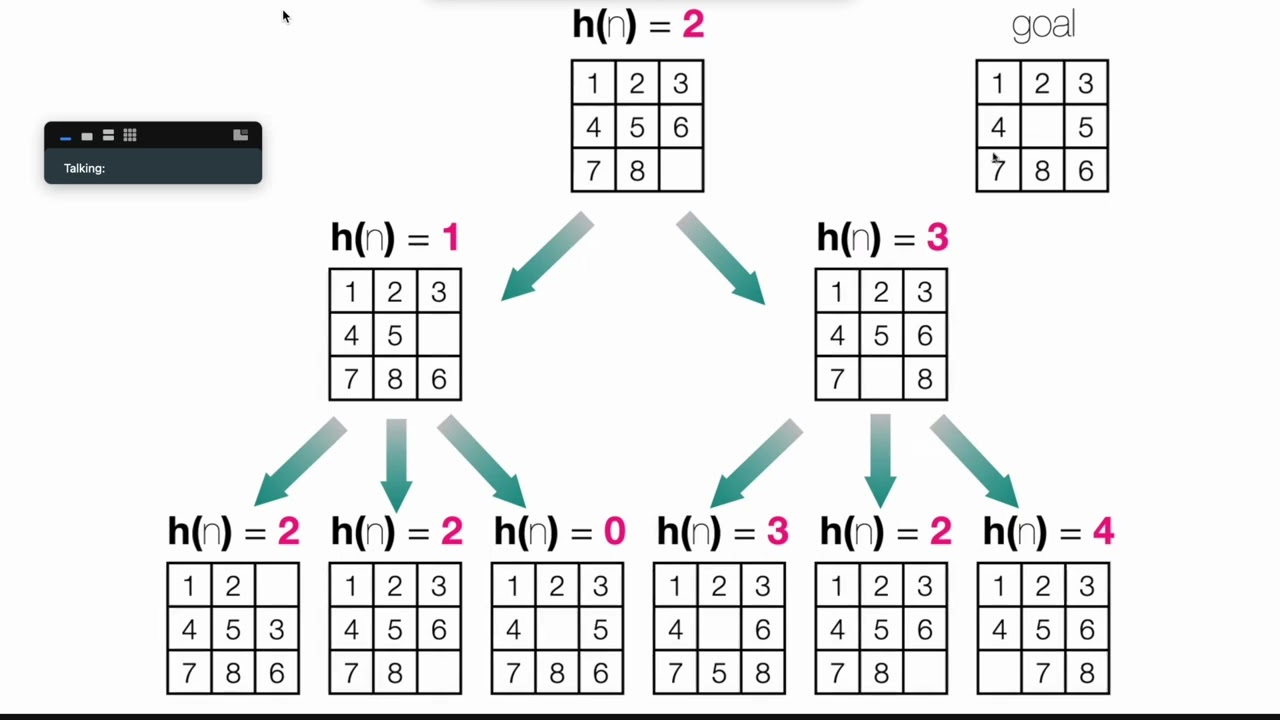

We need to create an algorithm to develop a policy for MDP and stochastic problem. These policies are solutions to the planning problem and stochastic shortest path algorithm. We will cover value iteration algorithm. Here we will see how MDP and Bellman equation works together. We will see how the transition function gives the probability. After that we will see how to minimize the cost.