Negative Sampling - Sequence Models скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Negative Sampling - Sequence Models в качестве 4k

У нас вы можете посмотреть бесплатно Negative Sampling - Sequence Models или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Negative Sampling - Sequence Models в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Negative Sampling - Sequence Models

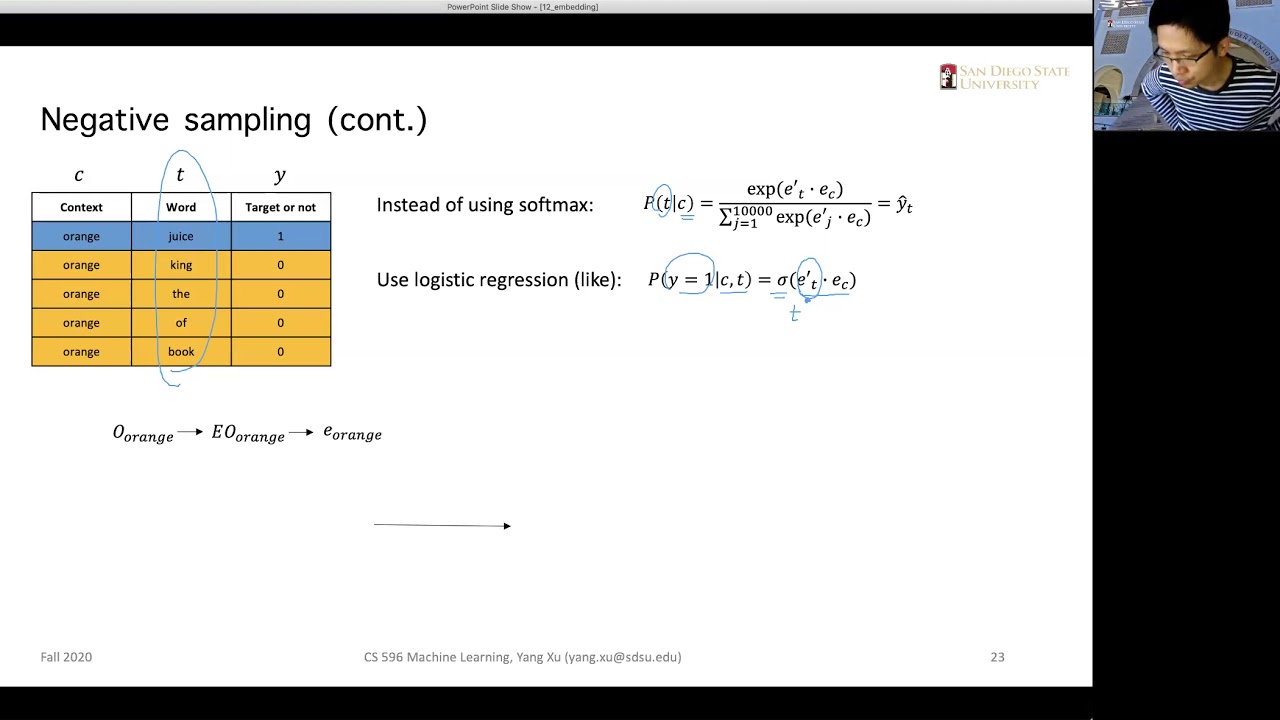

Link to this course: https://click.linksynergy.com/deeplin... Negative Sampling - Sequence Models Deep Learning Specialization This course will teach you how to build models for natural language, audio, and other sequence data. Thanks to deep learning, sequence algorithms are working far better than just two years ago, and this is enabling numerous exciting applications in speech recognition, music synthesis, chatbots, machine translation, natural language understanding, and many others. You will: Understand how to build and train Recurrent Neural Networks (RNNs), and commonly-used variants such as GRUs and LSTMs. Be able to apply sequence models to natural language problems, including text synthesis. Be able to apply sequence models to audio applications, including speech recognition and music synthesis. This is the fifth and final course of the Deep Learning Specialization. deeplearning.ai is also partnering with the NVIDIA Deep Learning Institute (DLI) in Course 5, Sequence Models, to provide a programming assignment on Machine Translation with deep learning. You will have the opportunity to build a deep learning project with cutting-edge, industry-relevant content. Recurrent Neural Network, Artificial Neural Network, Deep Learning, Long Short-Term Memory (ISTM) I am so grateful that Andrew and the team provided such good course, I learn so much from this course, I am so excited that see the wake word detection model actually work in the programming exercise,Loved the course - it was very interesting. It is also pretty complex, so will probably go through it again to review the concepts and how the models work. Thank you for this wonderful course series! Natural language processing with deep learning is an important combination. Using word vector representations and embedding layers you can train recurrent neural networks with outstanding performances in a wide variety of industries. Examples of applications are sentiment analysis, named entity recognition and machine translation. Negative Sampling - Sequence Models Copyright Disclaimer under Section 107 of the copyright act 1976, allowance is made for fair use for purposes such as criticism, comment, news reporting, scholarship, and research. Fair use is a use permitted by copyright statute that might otherwise be infringing. Non-profit, educational or personal use tips the balance in favour of fair use.