03. Training the DistilBERT classifier by feature extraction || Extraction of last hidden state скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: 03. Training the DistilBERT classifier by feature extraction || Extraction of last hidden state в качестве 4k

У нас вы можете посмотреть бесплатно 03. Training the DistilBERT classifier by feature extraction || Extraction of last hidden state или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон 03. Training the DistilBERT classifier by feature extraction || Extraction of last hidden state в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

03. Training the DistilBERT classifier by feature extraction || Extraction of last hidden state

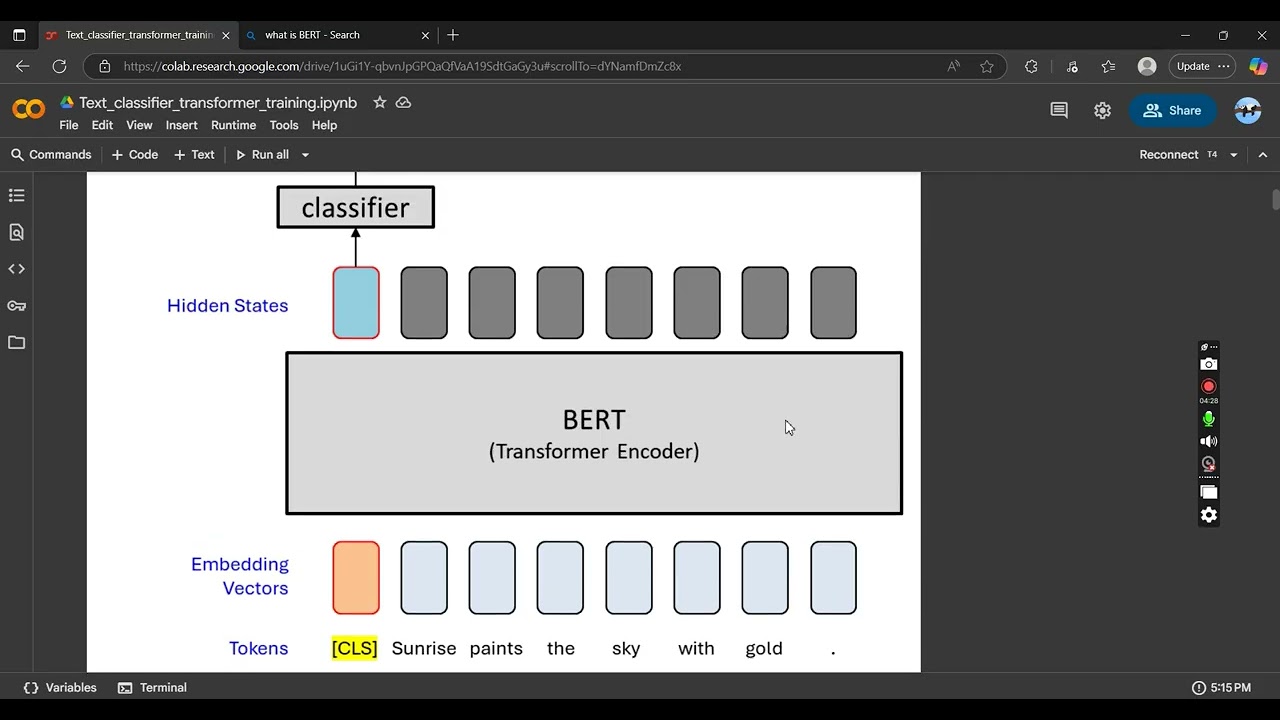

In this video, we dive deep into training a DistilBERT classifier using feature extraction. We focus on extracting the last hidden state of the model and using it to build a powerful text classification pipeline. You’ll learn: How to extract the last hidden states from DistilBERT using Hugging Face Transformers How to use these features for classifier training Building a text classification model without fine-tuning the full Transformer Evaluating the classifier performance on your dataset This tutorial is perfect for ML enthusiasts, NLP practitioners, and students who want to understand feature-based Transformer classification in a practical, step-by-step way. #DistilBERT #NLP #Transformers #FeatureExtraction #LastHiddenState #TextClassification #HuggingFace #PyTorch #MachineLearning #DeepLearning #AI #LanguageModels #NLPProjects #MLProjects #MLTutorial #AITutorial #DataScience #BERT #DistilBERTClassifier #TransformerModels #Tokenization #TextProcessing #NeuralNetworks #AIProjects

![Best of Deep House [2026] | Melodic House & Progressive Flow](https://imager.clipsaver.ru/Il-ZpBuC8tA/max.jpg)