How to Scale LLMs & AI Inference for Millions of Users in Real Time скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: How to Scale LLMs & AI Inference for Millions of Users in Real Time в качестве 4k

У нас вы можете посмотреть бесплатно How to Scale LLMs & AI Inference for Millions of Users in Real Time или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон How to Scale LLMs & AI Inference for Millions of Users in Real Time в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

How to Scale LLMs & AI Inference for Millions of Users in Real Time

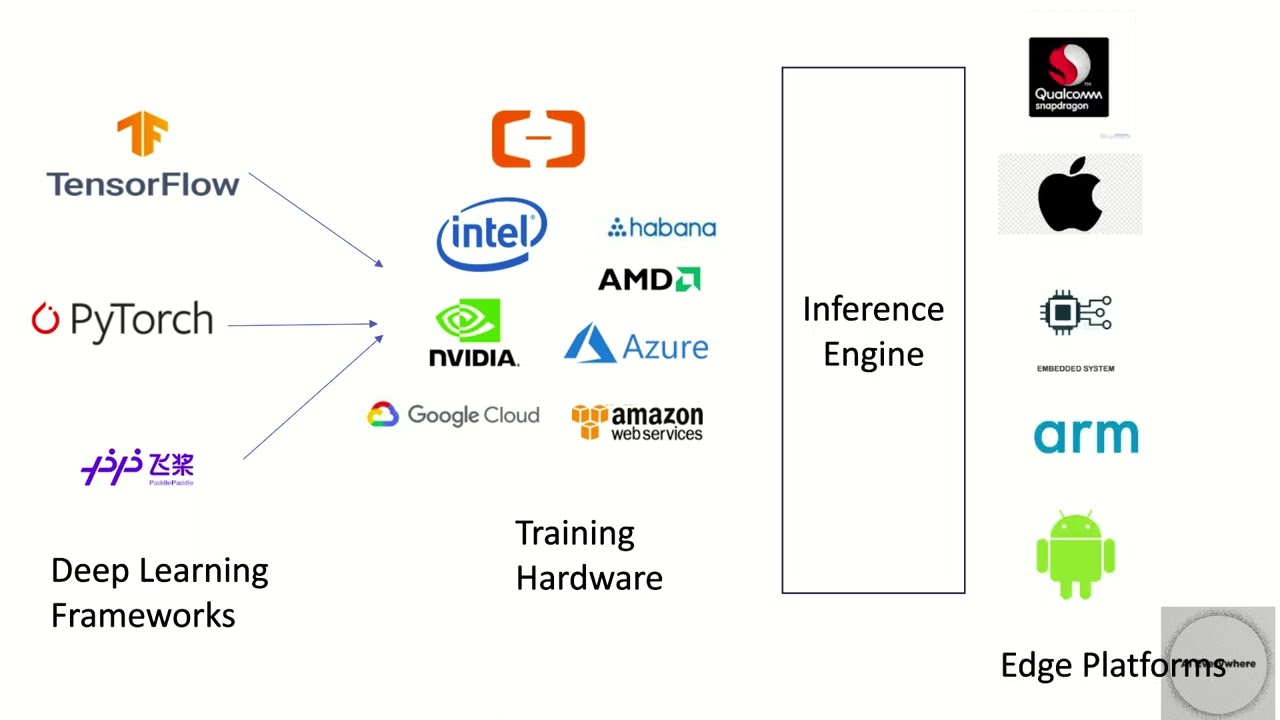

In this video, we dive deep into the critical role of inference in deploying large language models (LLMs) and other machine learning models. We explore how latency, throughput, and speed impact the user experience, especially during high-demand events like Black Friday or Big Billion Days. Learn how top inference providers, like Fireworks, optimize open-source models (Mistral, Llama) for ultra-fast API responses, ensuring your AI models deliver reliable, high-quality responses at scale. Discover cutting-edge techniques for improving your AI-powered web and e-commerce experiences. #AIInference #largelanguagemodels #aidevelopment #machinelearning #ai #ml