Spring Boot + Ollama | Run Local LLM with Spring AI скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Spring Boot + Ollama | Run Local LLM with Spring AI в качестве 4k

У нас вы можете посмотреть бесплатно Spring Boot + Ollama | Run Local LLM with Spring AI или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Spring Boot + Ollama | Run Local LLM with Spring AI в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Spring Boot + Ollama | Run Local LLM with Spring AI

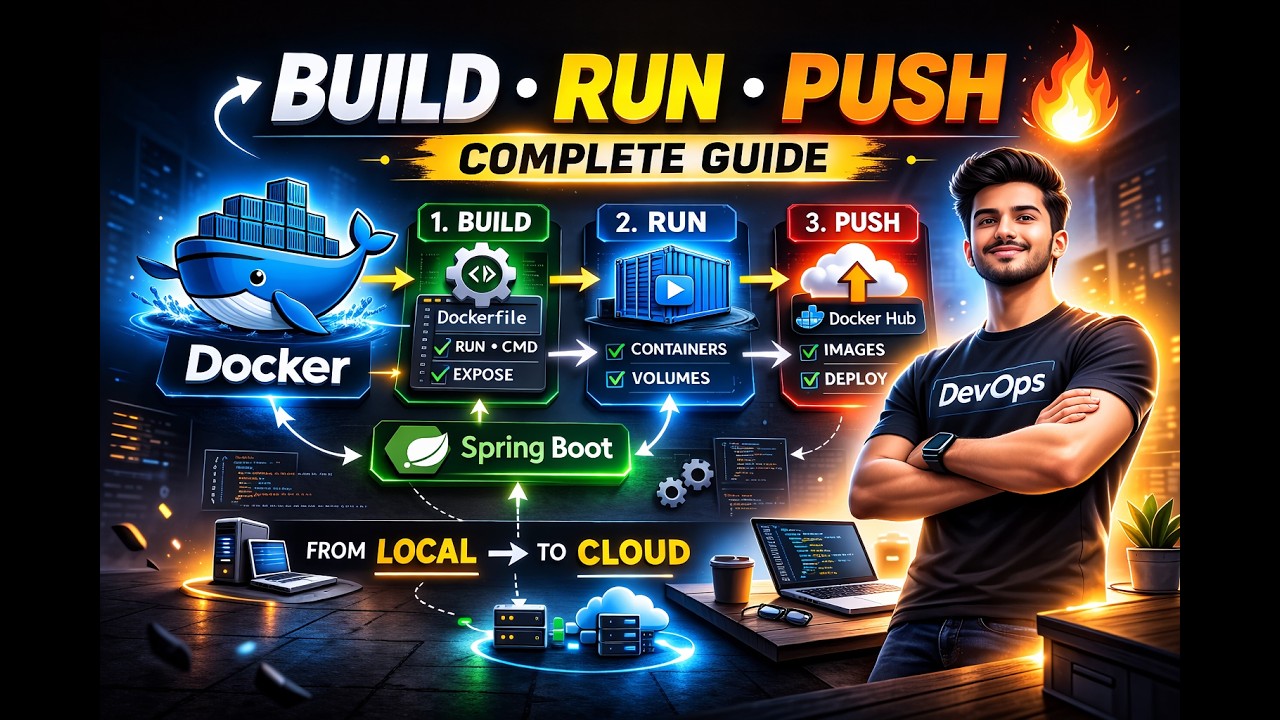

In this video we learn how to run a Large Language Model (LLM) locally using Ollama and integrate it with a Spring Boot application using Spring AI. In the previous video we connected Spring Boot with OpenAI. In this tutorial we explore how enterprises can run open-source LLM models locally instead of using cloud APIs. We will cover: • What is Ollama • Running open-source LLM models locally • Downloading and running Llama model • Replacing OpenAI dependency with Ollama in Spring AI • Configuring Spring Boot application.properties • Calling the local LLM from a Spring Boot REST API • Testing the API using Postman By the end of this tutorial, your Spring Boot application will be able to communicate with a locally running LLM model. This approach is very useful for organizations that want to keep their data inside their own infrastructure. Technologies used: Spring Boot Spring AI Ollama Llama Model Java REST APIs This video is part of the "Java Developer to AI Engineer" series. Subscribe for more tutorials on: Spring Boot Microservices Kafka DevOps Cloud AI integration with Java #SpringAI #SpringBoot #Ollama #LLM #JavaAI #LocalAI #Code2CloudX