Backpropagation: The Algorithm That Taught Machines to Learn скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Backpropagation: The Algorithm That Taught Machines to Learn в качестве 4k

У нас вы можете посмотреть бесплатно Backpropagation: The Algorithm That Taught Machines to Learn или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Backpropagation: The Algorithm That Taught Machines to Learn в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Backpropagation: The Algorithm That Taught Machines to Learn

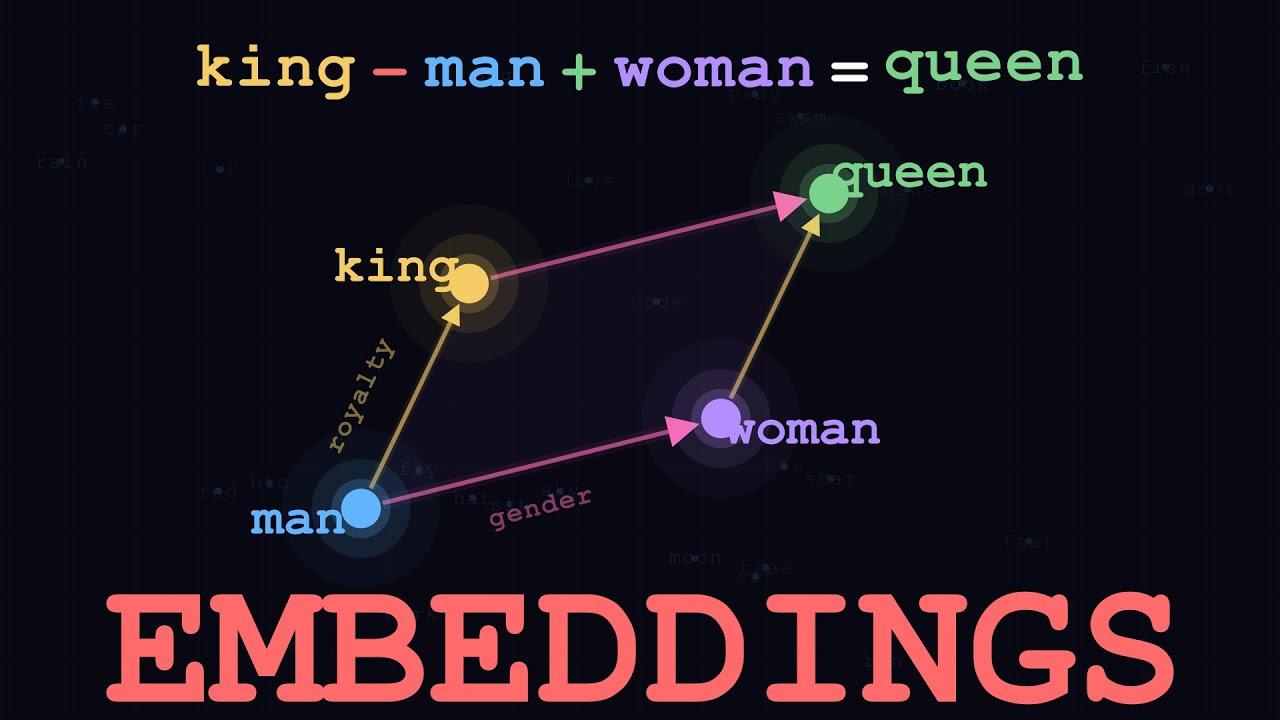

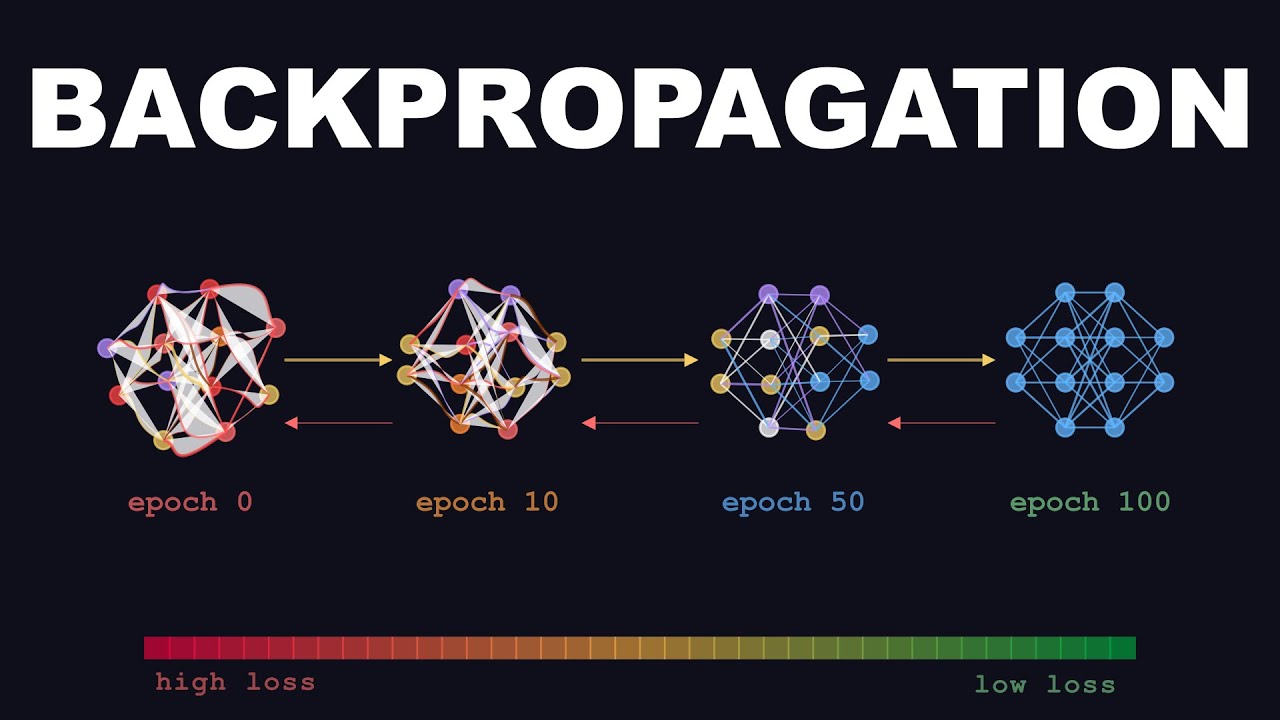

Every neural network you've ever used learned through one algorithm. Here's how it works — visually. Backpropagation is the chain rule applied to computation graphs — the algorithm that makes training neural networks with millions of weights possible in a single backward pass. Chapters: 0:00 Introduction 0:02 The Forward Pass 0:55 The Loss Function 1:49 The Chain Rule 3:05 Gradient Descent 4:08 Full Backpropagation 5:29 Outro What you'll learn: → How neural networks make predictions (forward pass) → How loss functions measure "wrongness" → How the chain rule traces errors backward → How gradient descent updates weights → Why backpropagation changed AI forever (1986) References: → Rumelhart, Hinton & Williams (1986) — "Learning representations by back-propagating errors" #Backpropagation #NeuralNetworks #DeepLearning