Deploying ecosystem Ai on OpenShift скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Deploying ecosystem Ai on OpenShift в качестве 4k

У нас вы можете посмотреть бесплатно Deploying ecosystem Ai on OpenShift или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Deploying ecosystem Ai on OpenShift в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Deploying ecosystem Ai on OpenShift

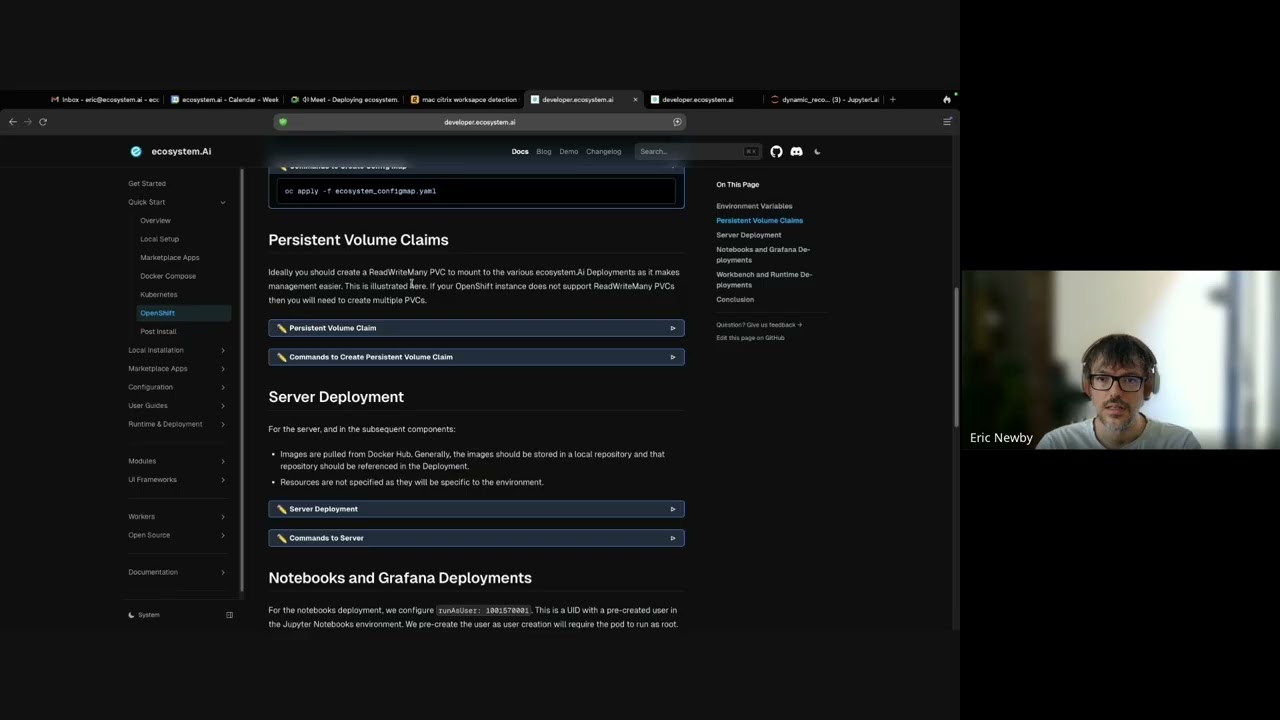

Delve into the deployment of various components of ecosystem.Ai within an OpenShift environment. We start with high-level environment variable setup, persistent volume claims, and server deployment, proceeding to notebook and Grafana deployments. Our focus is on achieving this without changing any of OpenShift's default security policies. Key differences and similarities between OpenShift and Kubernetes are discussed, along with environment-specific configurations and exposure commands for ports. The video also touches on nuances such as user management in Jupyter Notebooks, manual Grafana setup, and considerations for scaling and resource management. The session concludes with a Q&A on best practices for splitting components and transitioning between OpenShift and Kubernetes. 02:30 Setting Up Environment Variables 05:02 Persistent Volume Claims 07:57 Server Deployment 13:47 Notebooks and Grafana Deployment 20:27 Workbench and Runtime Deployment 27:40 Additional Components and Q&A