[Paper Review] Attention is All You Need (Transformer) —Å–∫–∞—á–∞—Ç—å –≤ —Ö–æ—Ä–æ—à–µ–º –∫–∞—á–µ—Å—Ç–≤–µ

–ü–æ–≤—Ç–æ—Ä—è–µ–º –ø–æ–ø—ã—Ç–∫—É...

![[Paper Review] Attention is All You Need (Transformer)](https://imager.clipsaver.ru/x_8cp4Vdnak/max.jpg)

–°–∫–∞—á–∞—Ç—å –≤–∏–¥–µ–æ —Å —é—Ç—É–± –ø–æ —Å—Å—ã–ª–∫–µ –∏–ª–∏ —Å–º–æ—Ç—Ä–µ—Ç—å –±–µ–∑ –±–ª–æ–∫–∏—Ä–æ–≤–æ–∫ –Ω–∞ —Å–∞–π—Ç–µ: [Paper Review] Attention is All You Need (Transformer) –≤ –∫–∞—á–µ—Å—Ç–≤–µ 4k

–£ –Ω–∞—Å –≤—ã –º–æ–∂–µ—Ç–µ –ø–æ—Å–º–æ—Ç—Ä–µ—Ç—å –±–µ—Å–ø–ª–∞—Ç–Ω–æ [Paper Review] Attention is All You Need (Transformer) –∏–ª–∏ —Å–∫–∞—á–∞—Ç—å –≤ –º–∞–∫—Å–∏–º–∞–ª—å–Ω–æ–º –¥–æ—Å—Ç—É–ø–Ω–æ–º –∫–∞—á–µ—Å—Ç–≤–µ, –≤–∏–¥–µ–æ –∫–æ—Ç–æ—Ä–æ–µ –±—ã–ª–æ –∑–∞–≥—Ä—É–∂–µ–Ω–æ –Ω–∞ —é—Ç—É–±. –î–ª—è –∑–∞–≥—Ä—É–∑–∫–∏ –≤—ã–±–µ—Ä–∏—Ç–µ –≤–∞—Ä–∏–∞–Ω—Ç –∏–∑ —Ñ–æ—Ä–º—ã –Ω–∏–∂–µ:

-

–ò–Ω—Ñ–æ—Ä–º–∞—Ü–∏—è –ø–æ –∑–∞–≥—Ä—É–∑–∫–µ:

–°–∫–∞—á–∞—Ç—å mp3 —Å —é—Ç—É–±–∞ –æ—Ç–¥–µ–ª—å–Ω—ã–º —Ñ–∞–π–ª–æ–º. –ë–µ—Å–ø–ª–∞—Ç–Ω—ã–π —Ä–∏–Ω–≥—Ç–æ–Ω [Paper Review] Attention is All You Need (Transformer) –≤ —Ñ–æ—Ä–º–∞—Ç–µ MP3:

–ï—Å–ª–∏ –∫–Ω–æ–ø–∫–∏ —Å–∫–∞—á–∏–≤–∞–Ω–∏—è –Ω–µ

–∑–∞–≥—Ä—É–∑–∏–ª–∏—Å—å

–ù–ê–ñ–ú–ò–¢–ï –ó–î–ï–°–¨ –∏–ª–∏ –æ–±–Ω–æ–≤–∏—Ç–µ —Å—Ç—Ä–∞–Ω–∏—Ü—É

–ï—Å–ª–∏ –≤–æ–∑–Ω–∏–∫–∞—é—Ç –ø—Ä–æ–±–ª–µ–º—ã —Å–æ —Å–∫–∞—á–∏–≤–∞–Ω–∏–µ–º –≤–∏–¥–µ–æ, –ø–æ–∂–∞–ª—É–π—Å—Ç–∞ –Ω–∞–ø–∏—à–∏—Ç–µ –≤ –ø–æ–¥–¥–µ—Ä–∂–∫—É –ø–æ –∞–¥—Ä–µ—Å—É –≤–Ω–∏–∑—É

—Å—Ç—Ä–∞–Ω–∏—Ü—ã.

–°–ø–∞—Å–∏–±–æ –∑–∞ –∏—Å–ø–æ–ª—å–∑–æ–≤–∞–Ω–∏–µ —Å–µ—Ä–≤–∏—Å–∞ ClipSaver.ru

[Paper Review] Attention is All You Need (Transformer)

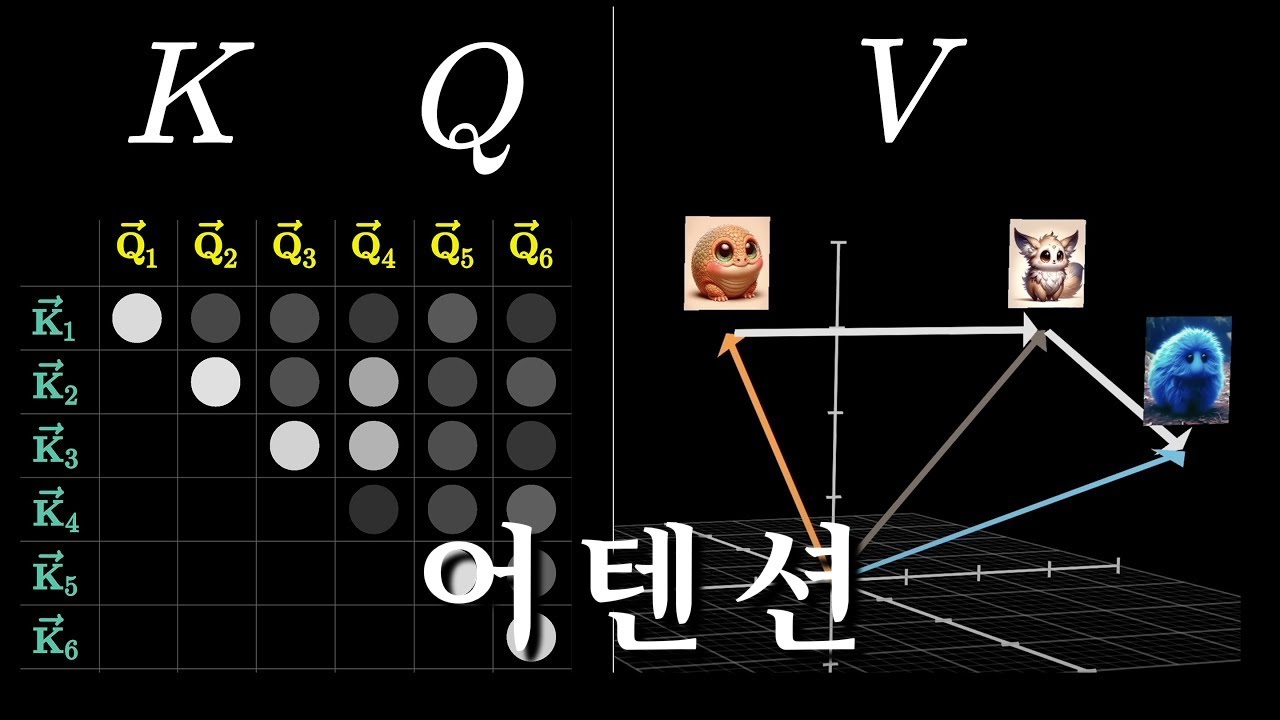

[Paper Review] Attention is All You Need (Transformer) [1] Î∞úÌëúÏûê : DSBA Ïó∞͵¨Ï㧠ÏÜåÍ∑úÏѱ [2] ÎֺΨ∏ÎßÅÌŨ : https://arxiv.org/abs/1706.03762 [3] ÏΩîÎìúÎßÅÌŨ : https://github.com/jadore801120/atten... ÎÇ¥Ïö© ÏàòÏÝï 34:00Í≥º 43:10 Î∂ÄÎ∂Ñ Ïû•ÌëúÏóêÏÑú, multihead self-attentionÏùò Í≤ΩÏö∞ ÎÇ¥Î∂ÄÏÝÅÏúºÎ°ú concatenate (headÎì§ÏùÑ Í≤∞Ìï©)Εº ÏàòÌñâÌïòÍ∏∞ ÎïåΨ∏Ïóê Í∑∏ζº ÏÉÅ concatÏùÑ ÏÝúÏô∏Ìï¥Ïïº ÎßûÏäµÎãàÎã§. (MSA -- residual connection -- layer normalization -- FFN) (Ï∞∏Í≥Ý: https://github.com/jadore801120/atten...)

![[Paper Review] Batch Normalization](https://imager.clipsaver.ru/4jAyXi7byd8/max.jpg)

![392. Is Subsequence [Leetcode –∑–∞–¥–∞—á–∏]](https://imager.clipsaver.ru/SyKF0qwzj3E/max.jpg)

![[딥러닝 기계 번역] Transformer: Attention Is All You Need (꼼꼼한 딥러닝 논문 리뷰와 코드 실습)](https://imager.clipsaver.ru/AA621UofTUA/max.jpg)

![[TTT] Ïñ¥ÌÖêÏÖò & ÏÖÄÌîÑ-Ïñ¥ÌÖêÏÖò Í∞ÄÏû• ÏßÅÍ¥ÄÏÝÅÏù∏ ÏѧΙÖ! (Attention & Self-Attention)](https://imager.clipsaver.ru/8E6-emm_QVg/max.jpg)

![[Paper Review] Denoising Diffusion Probabilistic Models](https://imager.clipsaver.ru/_JQSMhqXw-4/max.jpg)

![[Paper Review] ViT: An Image is Worth 16x16 Words:Transformers for Image Recognition at Scale](https://imager.clipsaver.ru/0kgDve_vC1o/max.jpg)

![[Paper Review] End-to-End Object Detection with Transformers (DETR)](https://imager.clipsaver.ru/q1wSykClIMk/max.jpg)

![[내돈내산 논문리뷰] Vision transformer 파헤치기](https://imager.clipsaver.ru/QkwNdgXcfkg/max.jpg)