Основы обучения с подкреплением | Объяснение Q-обучения для TD3 и Deep R скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Основы обучения с подкреплением | Объяснение Q-обучения для TD3 и Deep R в качестве 4k

У нас вы можете посмотреть бесплатно Основы обучения с подкреплением | Объяснение Q-обучения для TD3 и Deep R или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Основы обучения с подкреплением | Объяснение Q-обучения для TD3 и Deep R в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

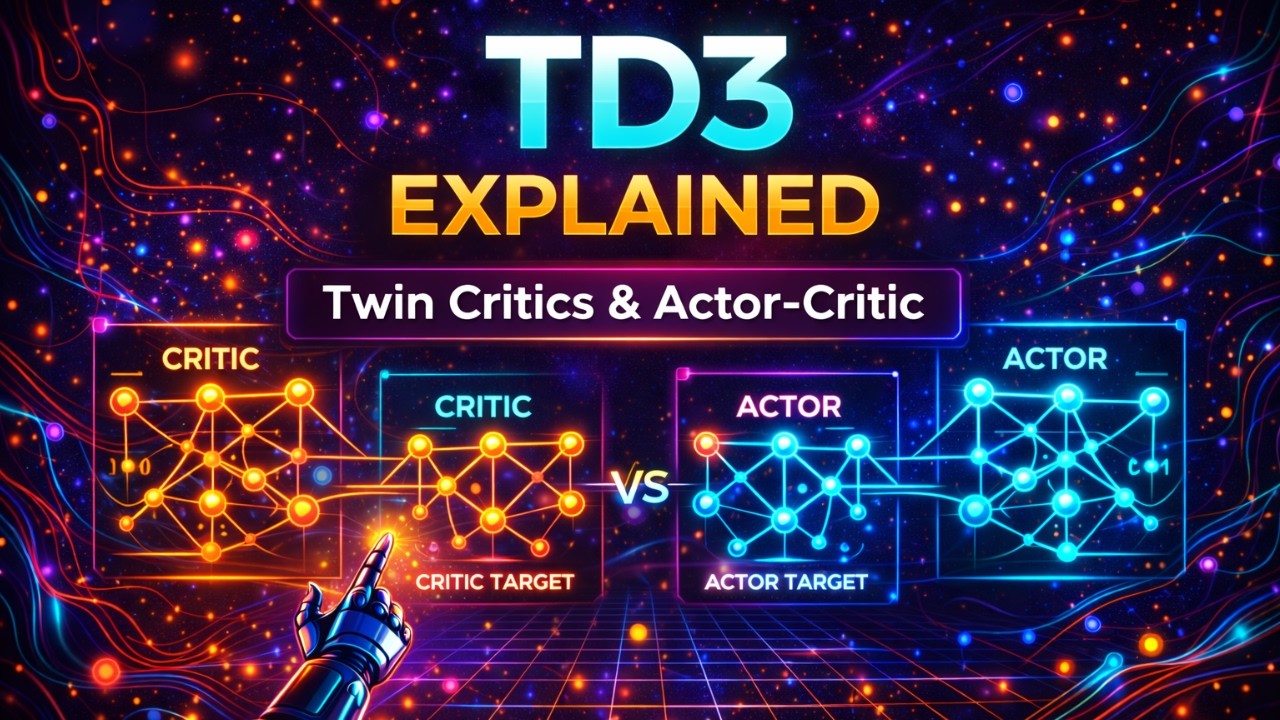

Основы обучения с подкреплением | Объяснение Q-обучения для TD3 и Deep R

🎓 Полный курс ЗДЕСЬ 👉 https://community.superdatascience.co... В этом уроке мы начнем изучать основные принципы работы продвинутых алгоритмов обучения с подкреплением, в частности, основы, необходимые для понимания TD3 (Twin Delayed DDPG). Прежде чем углубиться в TD3, нам необходимо понять два основных элемента: Основы обучения с подкреплением Основы Q-обучения Мы начнем с повторного рассмотрения принципа работы обучения с подкреплением: Агент взаимодействует с окружающей средой, наблюдает состояние, совершает действие, переходит в новое состояние и получает вознаграждение. Конечная цель? Максимизировать ожидаемую отдачу — накопленное вознаграждение за определенный период времени. Затем мы перейдем к Q-обучению, ключевому понятию TD3. Вы узнаете: Что представляют собой Q-значения Почему Q-значения измеряют «качество» пар «состояние-действие» Как агенты обучаются оптимальному поведению с помощью уравнения Беллмана Что такое обучение с временной разностью Как Q-значения сходятся посредством итеративных обновлений Мы также разъясним: Роль политики Важность ожидаемой отдачи Как TD3 одновременно обучается Q-значениям и параметрам политики Почему максимизация Q-значений приводит к оптимальному долгосрочному вознаграждению Этот урок закладывает концептуальную основу для всего последующего в глубоком обучении с подкреплением. ⏱️ Временные метки 00:00 – Введение в основы обучения с подкреплением 00:20 – Что такое обучение с подкреплением? 00:50 – Объяснение состояний, действий и вознаграждений 01:20 – Что такое отдача? 01:45 – Политика в обучении с подкреплением 02:45 – Почему Q-обучение важно для TD3 03:20 – Понимание Q-значений 04:10 – Пример лабиринта с Q-обучением 05:30 – Уравнение Беллмана 06:30 – Объяснение временной разницы 07:30 – Пошаговое обновление Q-значений 09:00 – Сходимость и оптимальная политика 🔎 Ключевые понятия Обучение с подкреплением Взаимодействие агента и окружающей среды Ожидаемая доходность Политика Q-значения Уравнение Беллмана Обучение с временной разностью Качество состояния-действия Основы TD3 🏷️ Хэштеги #ReinforcementLearning #DeepRL #QLearning #TD3 #МашинноеОбучение #ИскусственныйИнтеллект #ГрадиентПолитики #УравнениеБеллмана #ВременнаяРазность #АлгоритмыИИ