Why LLMs are LLMs going to a dead end? Future of AI скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Why LLMs are LLMs going to a dead end? Future of AI в качестве 4k

У нас вы можете посмотреть бесплатно Why LLMs are LLMs going to a dead end? Future of AI или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Why LLMs are LLMs going to a dead end? Future of AI в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

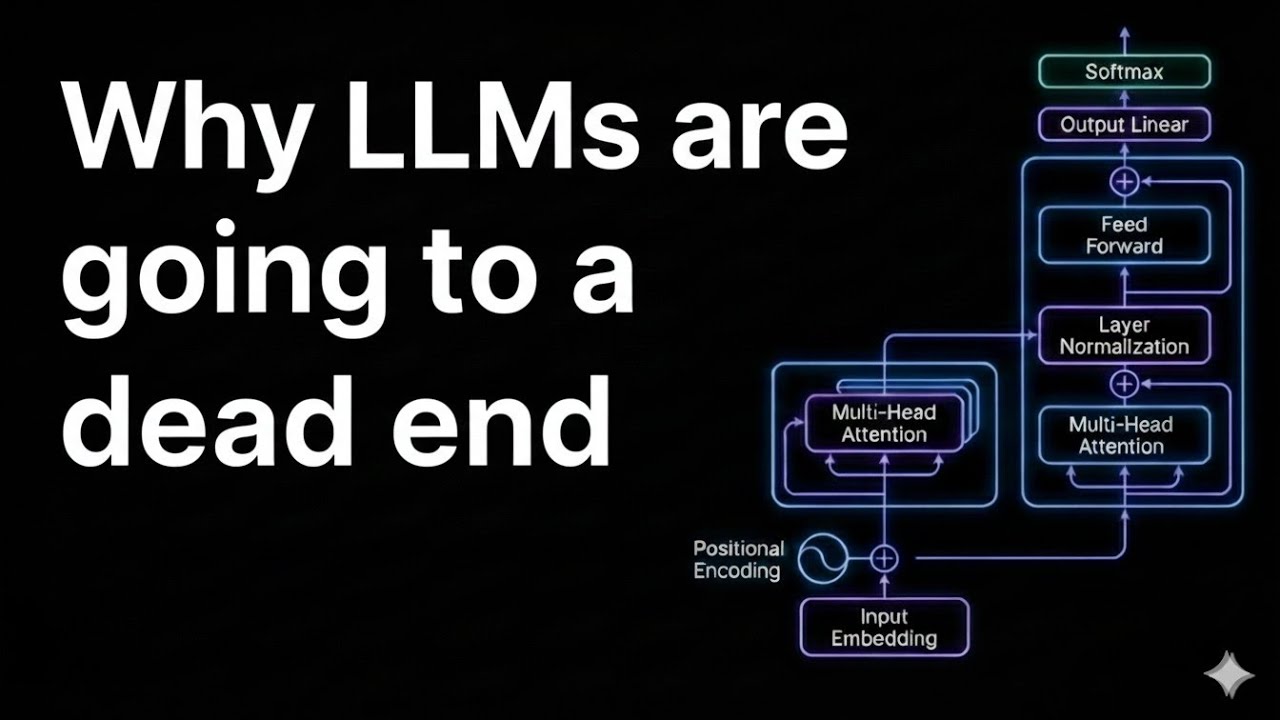

Why LLMs are LLMs going to a dead end? Future of AI

Large Language Models (LLMs) are typically autoregressive models, meaning they generate text one token at a time, predicting the next token based on the sequence of previous tokens. This sequential prediction is powered by transformer architectures, which leverage attention mechanisms to understand context and relationships across tokens. Autoregression allows LLMs to produce coherent and contextually relevant outputs, enabling tasks like text generation, summarization, and translation by iteratively sampling the most likely next token. You can also join our discord server for further discussion on this topic.

![The Dark Matter of AI [Mechanistic Interpretability]](https://imager.clipsaver.ru/UGO_Ehywuxc/max.jpg)

![Как внимание стало настолько эффективным [GQA/MLA/DSA]](https://imager.clipsaver.ru/Y-o545eYjXM/max.jpg)