Regularisation of Neural Networks by Enforcing Lipschitz Continuity скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Regularisation of Neural Networks by Enforcing Lipschitz Continuity в качестве 4k

У нас вы можете посмотреть бесплатно Regularisation of Neural Networks by Enforcing Lipschitz Continuity или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Regularisation of Neural Networks by Enforcing Lipschitz Continuity в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Regularisation of Neural Networks by Enforcing Lipschitz Continuity

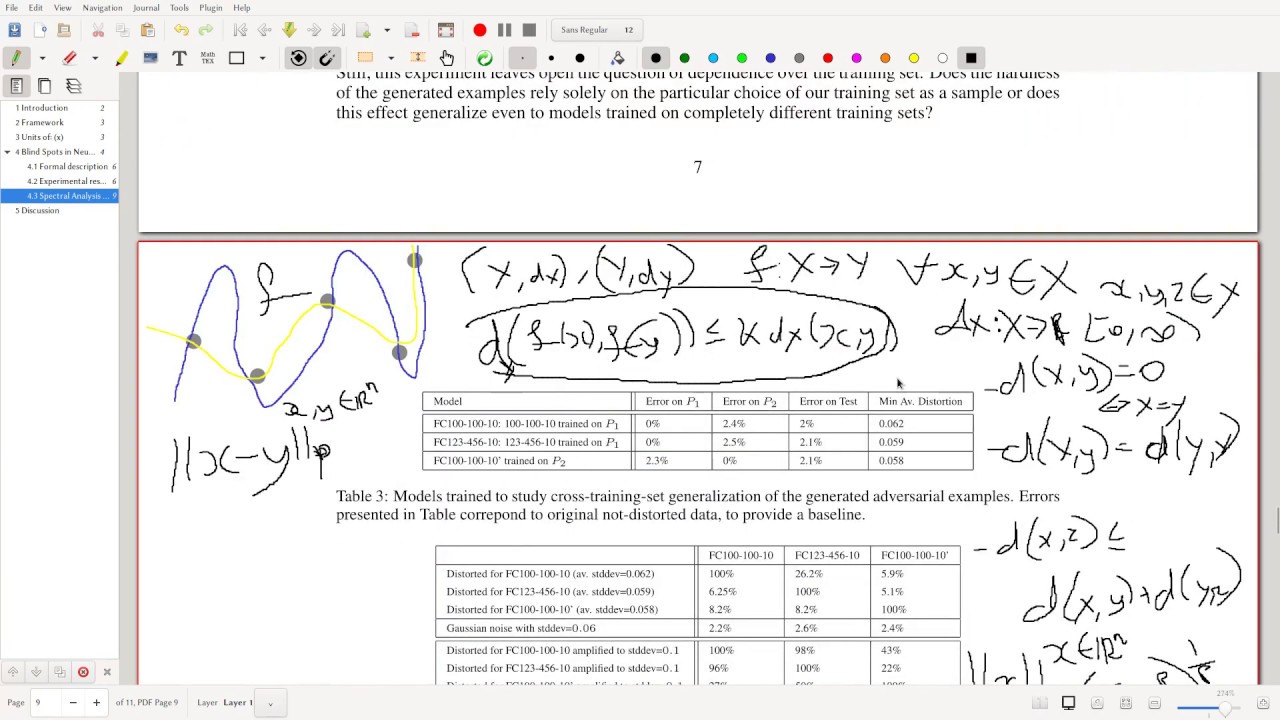

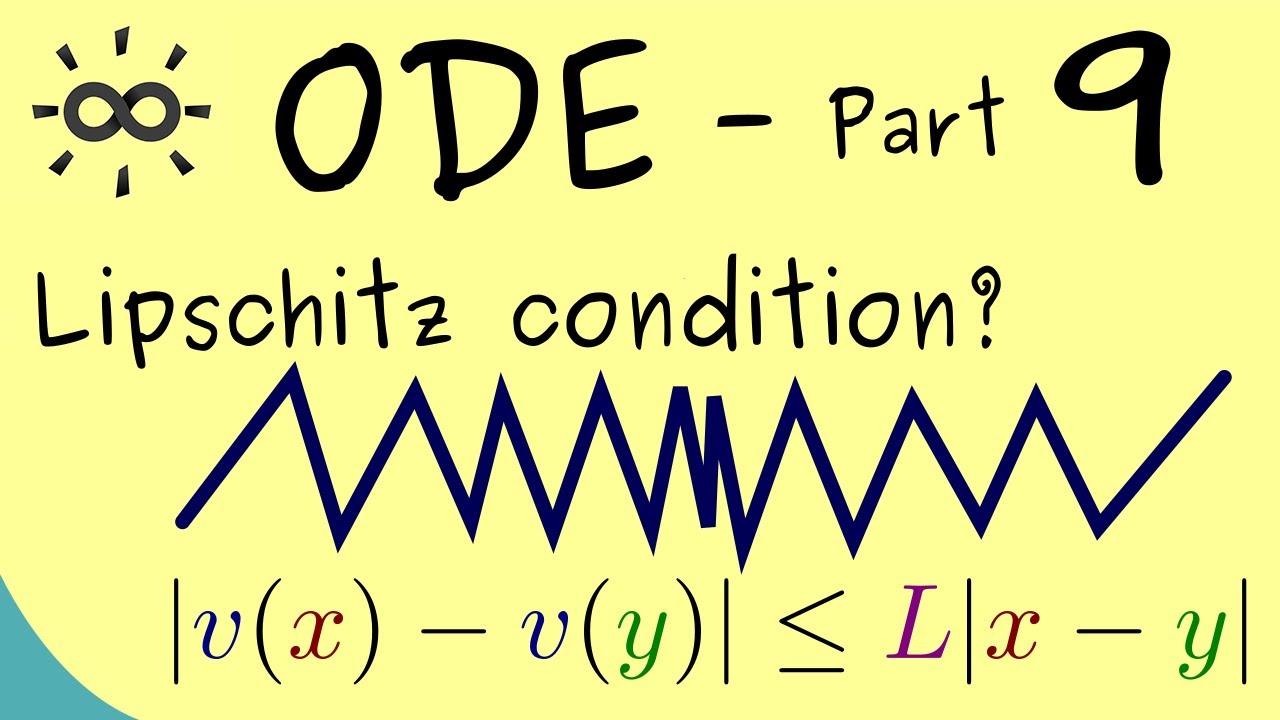

In this video we continue on the topic of Lipschitz continuity by presenting a paper which proposes a projection method to enforce it! Paper: https://arxiv.org/abs/1804.04368 Abstract: We investigate the effect of explicitly enforcing the Lipschitz continuity of neural networks with respect to their inputs. To this end, we provide a simple technique for computing an upper bound to the Lipschitz constant---for multiple p-norms---of a feed forward neural network composed of commonly used layer types. Our technique is then used to formulate training a neural network with a bounded Lipschitz constant as a constrained optimisation problem that can be solved using projected stochastic gradient methods. Our evaluation study shows that the performance of the resulting models exceeds that of models trained with other common regularisers. We also provide evidence that the hyperparameters are intuitive to tune, demonstrate how the choice of norm for computing the Lipschitz constant impacts the resulting model, and show that the performance gains provided by our method are particularly noticeable when only a small amount of training data is available.

![Как происходит модернизация остаточных соединений [mHC]](https://imager.clipsaver.ru/jYn_1PpRzxI/max.jpg)

![[Quiz] Regularization in Deep Learning, Lipschitz continuity, Gradient regularization](https://imager.clipsaver.ru/zAyDhZFup9k/max.jpg)