Теорема Гаусса-Маркова. Несмещенные оценки. Простая линейная регрессия.Метод наименьших квадратов скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Теорема Гаусса-Маркова. Несмещенные оценки. Простая линейная регрессия.Метод наименьших квадратов в качестве 4k

У нас вы можете посмотреть бесплатно Теорема Гаусса-Маркова. Несмещенные оценки. Простая линейная регрессия.Метод наименьших квадратов или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Теорема Гаусса-Маркова. Несмещенные оценки. Простая линейная регрессия.Метод наименьших квадратов в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Теорема Гаусса-Маркова. Несмещенные оценки. Простая линейная регрессия.Метод наименьших квадратов

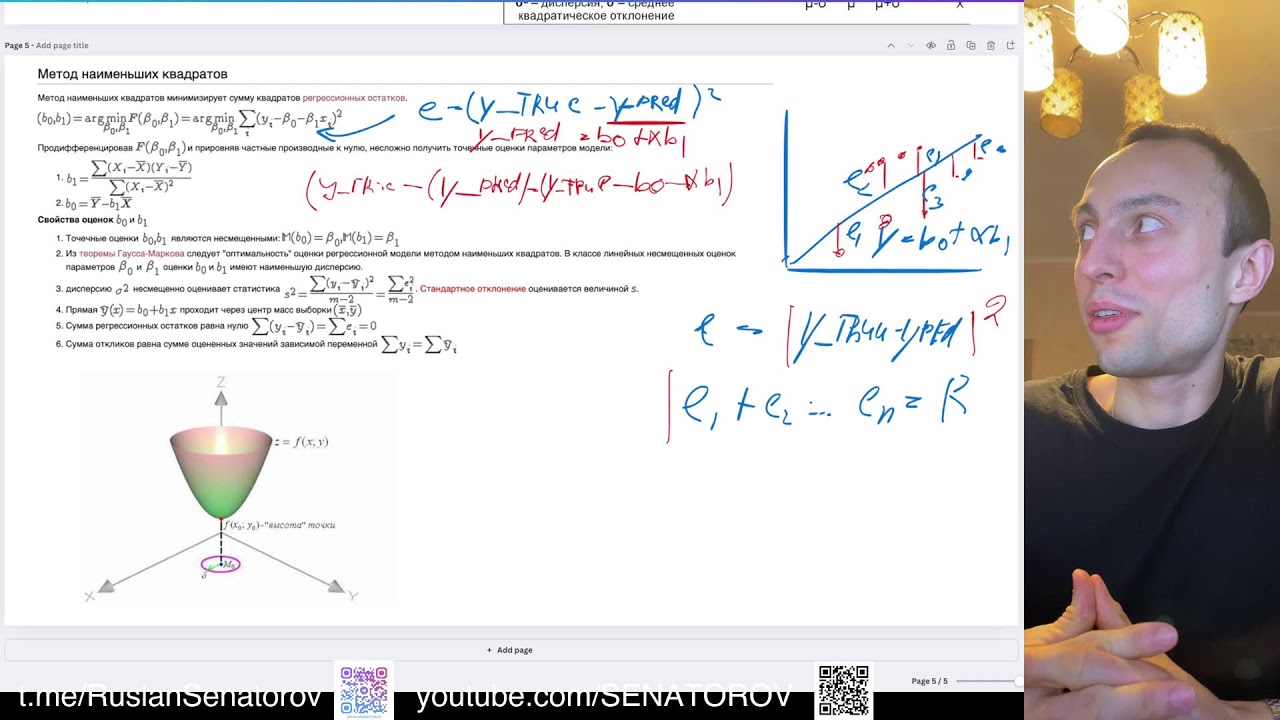

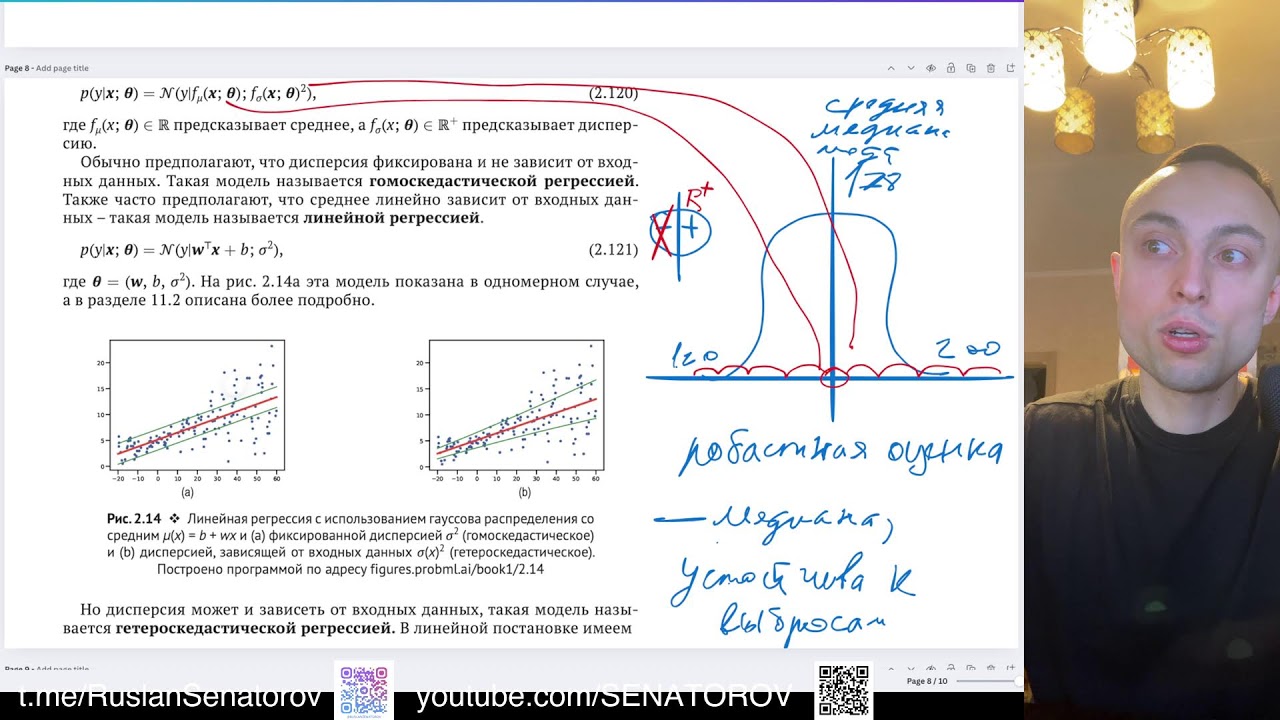

00:00:00 – Введение в регрессию: Одномерная регрессия, полиномиальная регрессия и краткий обзор других видов. 00:00:56 – Основы математического анализа: Введение в производные, моделирование на Desmos, функция потерь и теорема Гаусса-Маркова. 00:01:54 – Теорема Гаусса-Маркова: Метод наименьших квадратов как лучшая линейная несмещённая оценка, оценка распределения ошибок. 00:04:58 – Оценка и её оптимизация: Определение коэффициентов оценки и оптимизация линии регрессии для лучшего описания данных. 00:07:08 – Несмещенная оценка: Понятие несмещённой оценки, её математическое ожидание и значение репрезентативной выборки. 00:11:56 – Несмещенные оценки: Пример со средним арифметическим, равенство математического ожидания нулю при выполнении условий. 00:12:30 – Гомоскедастичность и гетероскедастичность: Различие между однородной и разрозненной дисперсией, вероятностный подход в регрессии. 00:14:29 – Нормальное распределение: Характеристика нормального распределения, симметрия и устойчивость медианы к выбросам. 00:17:18 – Рабасная оценка: Пример медианы как устойчивой к выбросам оценки. 00:19:54 – Нормальное распределение и параметры: Роль математического ожидания и дисперсии в формировании распределения. 00:22:32 – Гомоскедастичная регрессия: Модель с фиксированной дисперсией, использование линейной регрессии на Desmos. 00:23:24 – Введение в линейную регрессию: Построение линии по точкам, настройка угла и смещения, учет ошибки. 00:24:19 – Расчет ошибки: Определение расстояния от точек до линии и применение теоремы Гаусса-Маркова. 00:26:13 – Возведение в квадрат: Использование квадрата ошибки для устранения знаковых различий при суммировании. 00:28:55 – Общая ошибка и параметры: Расчет средней ошибки, введение параметров наклона и смещения с корректировкой через производные. 00:31:46 – Производные и терминология: Введение частных производных и обзор ключевых математических понятий регрессии. 00:33:48 – Заключение: Обзор гомоскедастичности и гетероскедастичности, планы на дальнейшие уроки и ответы на вопросы. 00:35:15 – Гетероскедастичность и гомоскедастичность: Сравнение моделей по изменению дисперсии и визуализация интервалов (95% прогнозов). 00:36:10 – Интервал доверия и распределение точек: Объяснение доверительного интервала и особенностей распределения точек при разных типах дисперсии. 00:37:07 – Заключение и пожелания: Итоговый обзор, коррекция распределения точек при больших значениях X и анонс будущих задач по регрессии, математике и Python. 🚀 Вступай в сообщество: https://boosty.to/SENATOROV 🍑 Подписывайся на Telegram: https://t.me/RuslanSenatorov 🔥 Начни работать с криптовалютой на Bybit: https://www.bybit.com/invite?ref=MAN2VD 💰 Донат: https://www.donationalerts.com/c/sena... 💰 Стать спонсором : (USDT TRC20) TPWP9kuqqetDNPeLjAe51F1i2jPxwYYBDu (USDT BEP20) 0xf3db7ce90a55d1d25b7a6d1ded811fb2a7523f3d Основные математические темы: Линейная алгебра: Векторы и матрицы Операции с матрицами (умножение, транспонирование, след) Собственные значения и собственные векторы Обратные матрицы Разложения (QR-разложение, SVD-разложение) Системы линейных уравнений Математический анализ: Пределы и непрерывность Производные и частные производные Градиенты и оптимизация Теория вероятностей: Случайные величины Распределения вероятностей (нормальное, биномиальное, пуассоновское) Условная вероятность Теорема Байеса Законы больших чисел и центральная предельная теорема Теги: Математика для машинного обучения, Линейная алгебра в Data Science, Математический анализ для машинного обучения, Теория вероятностей и статистика, Математика для анализа данных, Векторы и матрицы, Производные и градиенты, Распределения вероятностей, Регрессия и корреляция, Машинное обучение, Data Science обучение, Математические основы ML, Алгоритмы машинного обучения, линейная алгебра для машинного обучения, теория вероятностей в data science, математический анализ в ML, статистика для анализа данных, data science с нуля, машинное обучение для начинающих, Python для data science, R для анализа данных, numpy, pandas, scikit-learn, deep learning, нейронные сети, искусственный интеллект, #математика #datascience #machinelearning математика с нуля, математика для дата сайнс, математика для машинного обучения, математика для чайников, математика для начинающих, математика для программистов, математика для data science, репетитор по математике, преподаватель по математике, учитель по математике, учитель математики, ментор по математике, тичер по математике, репетитор по дата сайнс с нуля, репетитор по высшей математике, репетитор по математике для взрослых, математика для заочников математика для дата аналитика