[DMQA Open Seminar] Transformer in Computer Vision скачать в хорошем качестве

Повторяем попытку...

![[DMQA Open Seminar] Transformer in Computer Vision](https://imager.clipsaver.ru/bgsYOGhpxDc/max.jpg)

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: [DMQA Open Seminar] Transformer in Computer Vision в качестве 4k

У нас вы можете посмотреть бесплатно [DMQA Open Seminar] Transformer in Computer Vision или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон [DMQA Open Seminar] Transformer in Computer Vision в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

[DMQA Open Seminar] Transformer in Computer Vision

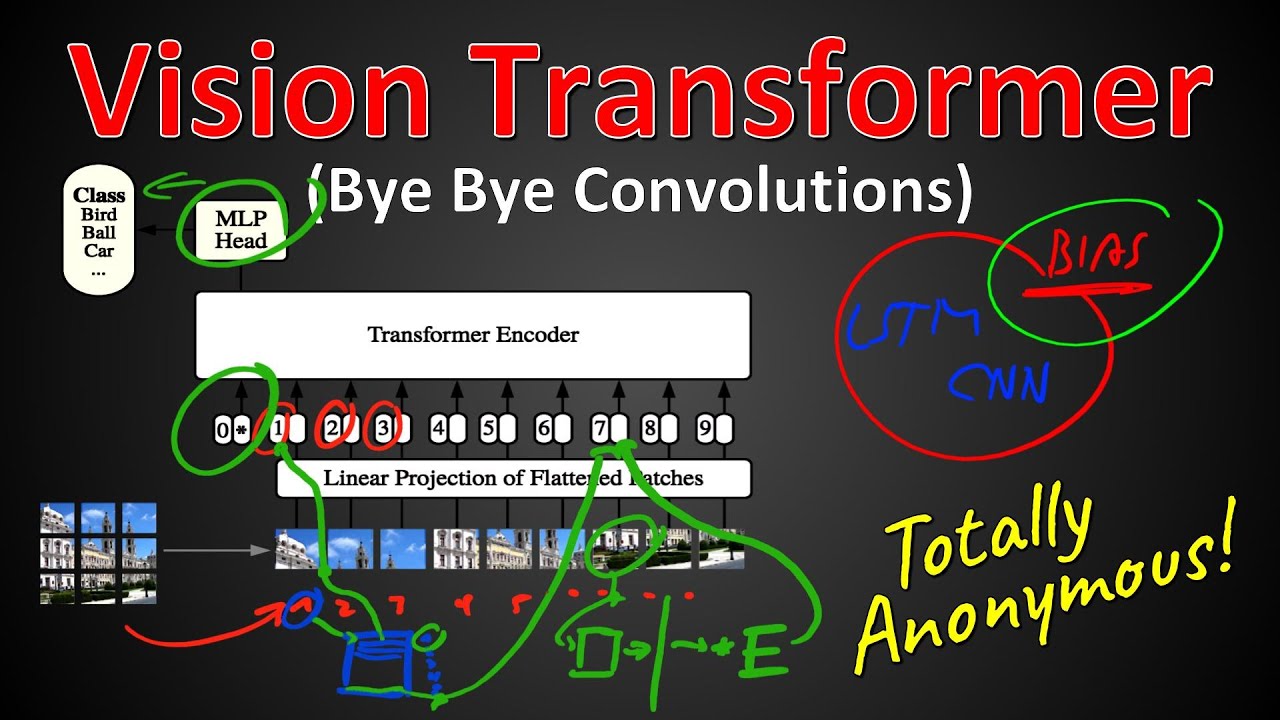

NLP 분야에서 Transformer가 큰 성공을 거두면서 Computer Vision 분야에도 많은 영향을 미치게 되었다. 지금까지의 연구들은 Transformer의 핵심인 Self Attention을 CNN에 적용하는 연구가 주를 이루었다면 최근에는 Transformer 구조 자체를 Computer Vision 분야에 적용한 연구들이 활발하게 수행되고 있다. 이번 세미나에서는 Transformer를 이미지 분류 문제에 적용한 Vision Transformer(ViT)와 이를 개선한 Data-efficient image Transformer(DeiT)에 대해 소개하고자 한다. 참고문헌 : 1. A. Dosovitskiy, L. Beyer, A. Kolesnikov, D. Weissenborn, X. Zhai, T. Unterthiner, M. Dehghani, M. Minderer, G. Heigold, S. Gelly, J. Uszkoreit, and N. Houlsby, "An image is worth 16x16 words: Transformers for image recognition at scale," arXiv preprint arXiv:2010.11929, 2020. 2. H. Touvron, M. Cord, M. Douze, F. Massa, A. Sablayrolles, and H. J´egou, “Training data-efficient image transformers & distillation through attention,” arXiv preprint arXiv:2012.12877, 2020. 3. S. Khan, M. Naseer, M. Hayat, S. W. Zamir, F. S. Khan, and M. Shah, "Transformers in vision: A survey," arXiv preprint arXiv:2101.01169, 2021.

![[DMQA Open Seminar] Graph Attention Networks](https://imager.clipsaver.ru/NSjpECvEf0Y/max.jpg)

![[DMQA Open Seminar] Transformer](https://imager.clipsaver.ru/KT58deB6oPQ/max.jpg)

![[Open DMQA Seminar] Vision-Language Model-Based Anomaly Detection](https://imager.clipsaver.ru/qT18XtbcYwg/max.jpg)

![[DMQA Open Seminar] Graph-Based Semi-supervised Learning](https://imager.clipsaver.ru/0d2jh3sCdM4/max.jpg)

![LLM 바닥부터 만들기 (대형언어모델) 1시간 핵심 정리! - #1 사전학습 [홍정모 연구소]](https://imager.clipsaver.ru/osv2csoHVAo/max.jpg)

![[TTT] 어텐션 & 셀프-어텐션 가장 직관적인 설명! (Attention & Self-Attention)](https://imager.clipsaver.ru/8E6-emm_QVg/max.jpg)

![[Paper Review] Swin Transformer: Hierarchical Vision Transformer using Shifted Windows](https://imager.clipsaver.ru/2lZvuU_IIMA/max.jpg)

![[딥러닝 기계 번역] Transformer: Attention Is All You Need (꼼꼼한 딥러닝 논문 리뷰와 코드 실습)](https://imager.clipsaver.ru/AA621UofTUA/max.jpg)