Neurosymbolic AI and the Shortcomings of LLMs: Jacob Andra and Stephen Karafiath скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Neurosymbolic AI and the Shortcomings of LLMs: Jacob Andra and Stephen Karafiath в качестве 4k

У нас вы можете посмотреть бесплатно Neurosymbolic AI and the Shortcomings of LLMs: Jacob Andra and Stephen Karafiath или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Neurosymbolic AI and the Shortcomings of LLMs: Jacob Andra and Stephen Karafiath в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Neurosymbolic AI and the Shortcomings of LLMs: Jacob Andra and Stephen Karafiath

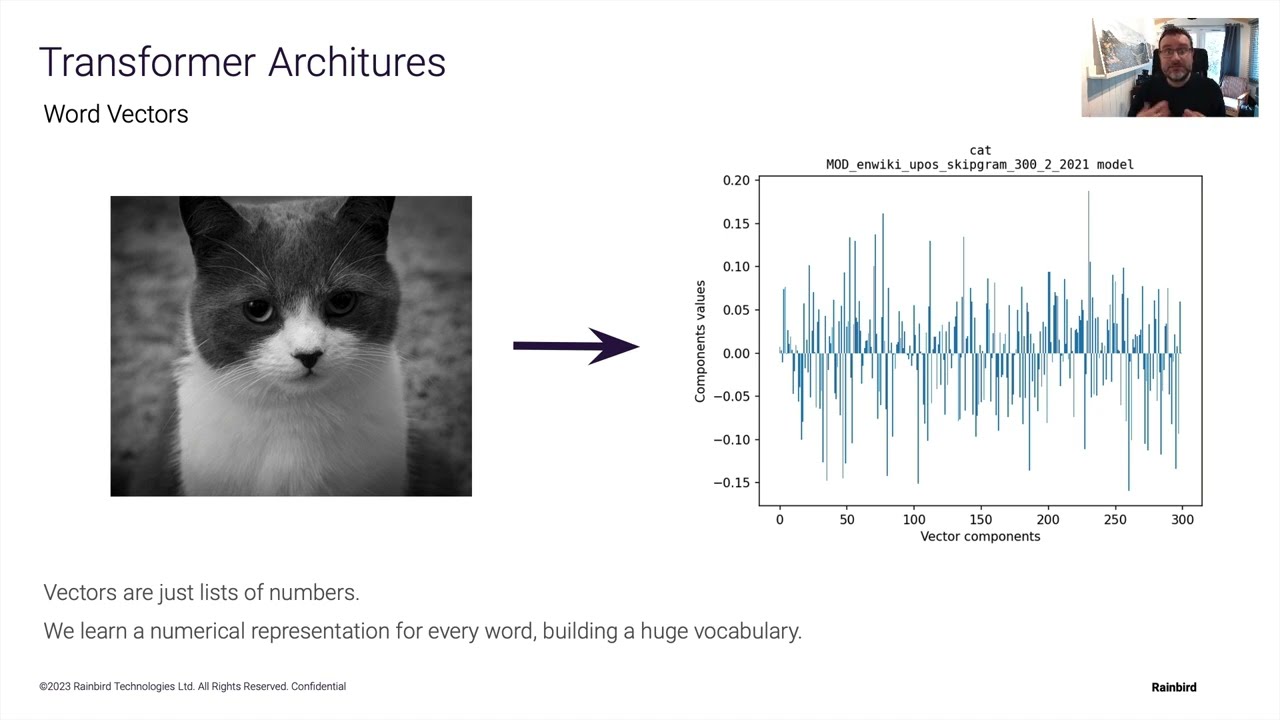

Large language models have captured headlines, but they represent only a fraction of what AI can accomplish. In this episode of The Applied AI Podcast, Talbot West co-founders Jacob Andra and Stephen Karafiath explore the fundamental limitations of LLMs and why neurosymbolic AI offers a more robust path forward for enterprise applications. The conversation starts with a counterintuitive observation: LLMs sometimes display remarkable contextual awareness, like when ChatGPT proactively noticed specific tile flooring in a photo's background and offered unsolicited cleaning advice. These moments suggest genuine intelligence. But as Jacob and Stephen explain, push these systems harder and the cracks appear. The hosts examine specific failure modes that emerge when deploying LLMs at scale. Jacob documents persistent formatting errors where models swing between extremes—overusing lists, then refusing to use them at all, even when instructions explicitly define appropriate use cases. These aren't random glitches. They reveal systematic overcorrection behaviors where LLMs bounce off guardrails rather than operating within defined bounds. More troubling are the logical inconsistencies. When working with large corpuses of information, LLMs demonstrate what Jacob calls cognitive fallacies—errors that mirror human reasoning failures but stem from different causes. The models cannot maintain complex instructions across extended tasks. They hallucinate citations, fabricate data, and contradict themselves when context windows stretch too far. Even the latest reasoning models cannot eliminate certain habits, like the infamous em-dash overuse, no matter how explicitly you prompt against it. Stephen introduces the deny-affirm construction as another persistent pattern: "It's not X, it's Y" formulations that plague AI-generated content. Tell the model to avoid this construction and watch it appear anyway, sometimes in the very next paragraph. These aren't bugs to be patched. They're symptoms of fundamental architectural limitations. The solution lies in neurosymbolic AI, which combines neural networks with symbolic reasoning systems. Jacob and Stephen use an extended biological analogy: LLMs are like organisms without skeletons. A paramecium works fine at microscopic scale, but try to build something elephant-sized from the same squishy architecture and it collapses under its own weight. The skeleton—knowledge graphs, structured data, formal logic—provides the rigid structure necessary for complex reasoning at scale. This matters for enterprise deployment. Creative tasks can tolerate hallucinations and imprecision. A whale-sized LLM works fine in the ocean of creative writing. But data analysis, compliance work, and mission-critical decision support require structured reasoning that current LLMs cannot deliver alone. Move that whale onto land and watch it fail. The good news: we can use LLMs to build better symbolic structures. They excel at helping create taxonomies and knowledge graphs when properly constrained. Human experts remain irreplaceable for validation and oversight, but AI can accelerate the construction of the scaffolding that will eventually support more capable hybrid systems. Jacob shares insights from his ongoing research documenting comprehensive error categories across LLM implementations. Stephen explains why the scaling laws that drove exponential improvements have plateaued. We're now seeing incremental gains rather than the dramatic leaps that characterized the transformer era. AGI remains distant, possibly requiring multiple paradigm shifts as significant as the transformer architecture itself. This plateau is actually welcome. Enterprises have a decade of valuable work implementing current technology before the next major breakthrough arrives. The rush to AGI has distracted from the practical value available right now through careful architecture that acknowledges both the strengths and limitations of available tools. Learn more about neurosymbolic approaches: https://talbotwest.com/ai-insights/wh... About the hosts: Jacob Andra is CEO of Talbot West. He pushes the limits of what AI can accomplish in high-stakes use cases and publishes extensively on AI, enterprise transformation, and policy, covering topics including explainability, responsible AI, and systems integration. Stephen Karafiath is SVP of Solutions Architecture at Talbot West, where he architects and deploys AI solutions that bridge the gap between theoretical capabilities and practical business outcomes. His work focuses on identifying the specific failure modes of AI systems and developing robust approaches to enterprise implementation. About Talbot West: Talbot West delivers Fortune 500-level AI consulting and implementation to midmarket and enterprise organizations.