What is RAG in AI? And how to reduce LLM hallucinations | AI Engineering in Five Minutes скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: What is RAG in AI? And how to reduce LLM hallucinations | AI Engineering in Five Minutes в качестве 4k

У нас вы можете посмотреть бесплатно What is RAG in AI? And how to reduce LLM hallucinations | AI Engineering in Five Minutes или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон What is RAG in AI? And how to reduce LLM hallucinations | AI Engineering in Five Minutes в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

What is RAG in AI? And how to reduce LLM hallucinations | AI Engineering in Five Minutes

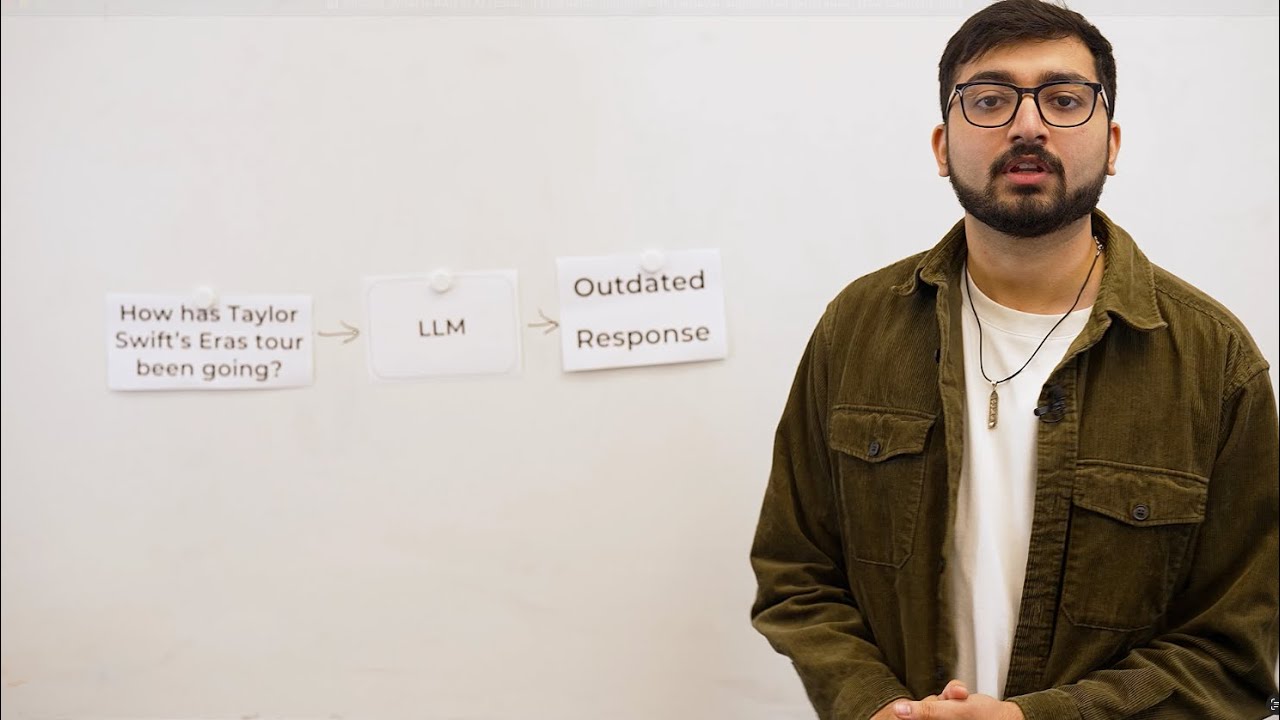

Hallucinations are one of the biggest challenges with Large Language Models (LLMs). These occur when AI generates confident but factually incorrect answers. In this episode of Data and AI Engineering in Five Minutes, Shivam Chandarana (Technical Lead, Softwire) explains: Why LLMs hallucinate How Retrieval-Augmented Generation (RAG) improves LLM workflow How RAG helps deliver more personalised and reliable outputs If you’re working with AI tools and want to understand how to reduce hallucinations in your models, this video gives you a practical overview in just five minutes. 👉 Subscribe for more short videos on Data and AI Engineering. #AI #LLM #RAG #ArtificialIntelligence #MachineLearning #DataEngineering -- See how our diligent approach to Data and AI Engineering is helping some of the most impactful organisations across the private and public sectors: https://www.softwire.com/our-work/