ConvNeXt: A ConvNet for the 2020s скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: ConvNeXt: A ConvNet for the 2020s в качестве 4k

У нас вы можете посмотреть бесплатно ConvNeXt: A ConvNet for the 2020s или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон ConvNeXt: A ConvNet for the 2020s в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

ConvNeXt: A ConvNet for the 2020s

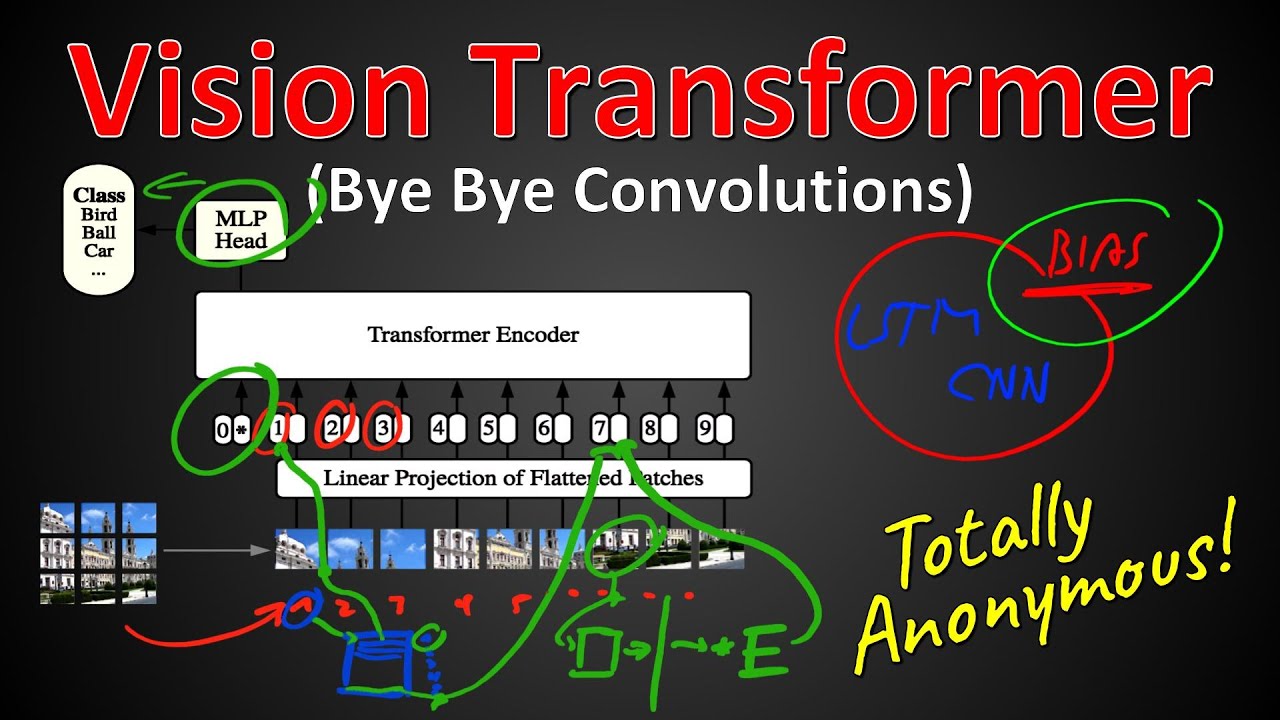

ConvNeXt: A ConvNet for the 2020s The "Roaring 20s" of visual recognition began with the introduction of Vision Transformers (ViTs), which quickly superseded ConvNets as the state-of-the-art image classification model. A vanilla ViT, on the other hand, faces difficulties when applied to general computer vision tasks such as object detection and semantic segmentation. It is the hierarchical Transformers (e.g., Swin Transformers) that reintroduced several ConvNet priors, making Transformers practically viable as a generic vision backbone and demonstrating remarkable performance on a wide variety of vision tasks. However, the effectiveness of such hybrid approaches is still largely credited to the intrinsic superiority of Transformers, rather than the inherent inductive biases of convolutions. In this work, we reexamine the design spaces and test the limits of what a pure ConvNet can achieve. We gradually "modernize" a standard ResNet toward the design of a vision Transformer, and discover several key components that contribute to the performance difference along the way. The outcome of this exploration is a family of pure ConvNet models dubbed ConvNeXt. Constructed entirely from standard ConvNet modules, ConvNeXts compete favorably with Transformers in terms of accuracy and scalability, achieving 87.8% ImageNet top-1 accuracy and outperforming Swin Transformers on COCO detection and ADE20K segmentation, while maintaining the simplicity and efficiency of standard ConvNets. Paper link: https://arxiv.org/abs/2201.03545 Official code: https://github.com/facebookresearch/C... Video Outline: 0:00 - Introduction 1:00 - Training Techniques 2:59 - Macro Design 5:02 - ResNeXt-ify 5:51 - Inversted Bottleneck 6:44 - Micro Design 8:15 - Summary of ConvNeXt Architecture 9:01 - Empirical Evaluation 9:21 - Results *AI Bites* YouTube: / aibites Twitter: / ai_bites Patreon: / ai_bites Github: https://github.com/ai-bites Swin Transformer: • Swin Transformer: Hierarchical Vision Tran... Vision Transformers (ViT): • Vision Transformer (ViT) - An Image is Wor... Data Efficient Image Transformer (DeiT): • DeiT - Data-efficient image transformers &... 📚 📚 📚 BOOKS I HAVE READ, REFER AND RECOMMEND 📚 📚 📚 📖 Deep Learning by Ian Goodfellow - https://amzn.to/3Wnyixv 📙 Pattern Recognition and Machine Learning by Christopher M. Bishop - https://amzn.to/3ZVnQQA 📗 Machine Learning: A Probabilistic Perspective by Kevin Murphy - https://amzn.to/3kAqThb 📘 Multiple View Geometry in Computer Vision by R Hartley and A Zisserman - https://amzn.to/3XKVOWi Music: https://www.bensound.com #machinelearning #aibites #deeplearning #convnext #visiontransformers #computervision