(ViT) An Image Is Worth 16x16 Words | Paper Explained скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: (ViT) An Image Is Worth 16x16 Words | Paper Explained в качестве 4k

У нас вы можете посмотреть бесплатно (ViT) An Image Is Worth 16x16 Words | Paper Explained или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон (ViT) An Image Is Worth 16x16 Words | Paper Explained в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

(ViT) An Image Is Worth 16x16 Words | Paper Explained

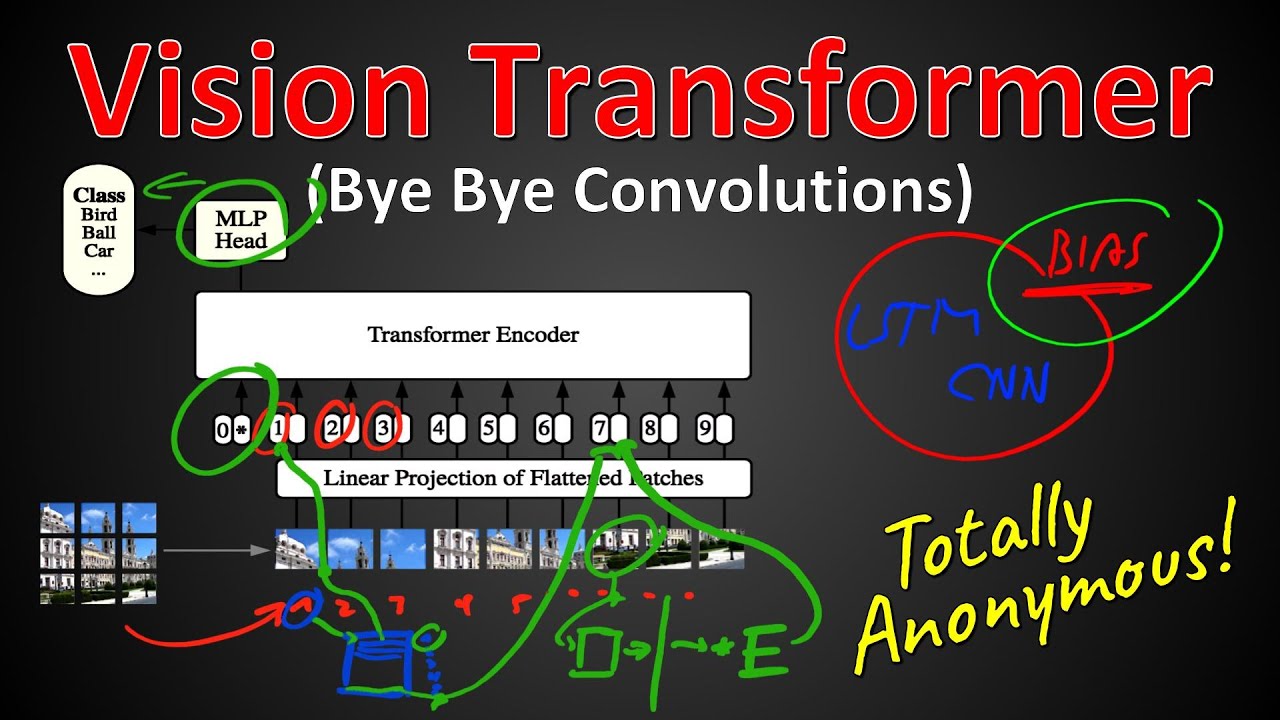

New video about Vision Transformer(ViT) on my channel. As more flexible architecture, Transformers completely overtook the NLP field, but because of the quadratic cost of attention mechanism its application to Computer Vision field remained limited. “An Image is Worth 16x16 Words” paper is the first successful application of Transformers that beat the previous state-of-the-art results in image classification task. So in this video, I will explain concepts like: the motivation behind transformers in Computer Vision how the ViT works results they achieved the effect of model and dataset size on the performance of ViT the future directions and limitations of this models In the next video I will show the PyTorch code with pre-trained weights, so stay tuned for that! ▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬ Paper: https://arxiv.org/abs/2010.11929 ▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬ Medium article about Weight Standardisation and Group Normalization: / overview-of-normalization-techniques-in-de... ▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬ Connect with me on: Linkedin - / maciej-balawejder-rt8015 GitHub - https://github.com/maciejbalawejder Medium - / maciejbalawejder Buy Me a Coffee - [https://www.buymeacoffee.com/mbalawejder](https://www.buymeacoffee.com/mbalawejder) ▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬▬ Timestamps: 0:00 Introduction 1:20 Transformer Pros/Cons 2:34 CNNs Pros/Cons 3:36 Related work 4:49 How ViT works? 6:24 Training process 7:48 Results 9:21 Insights from the results 12:20 Conclusions