Tutorial on the Fast Gradient Sign Method for Adversarial Samples скачать в хорошем качестве

Повторяем попытку...

Скачать видео с ютуб по ссылке или смотреть без блокировок на сайте: Tutorial on the Fast Gradient Sign Method for Adversarial Samples в качестве 4k

У нас вы можете посмотреть бесплатно Tutorial on the Fast Gradient Sign Method for Adversarial Samples или скачать в максимальном доступном качестве, видео которое было загружено на ютуб. Для загрузки выберите вариант из формы ниже:

-

Информация по загрузке:

Скачать mp3 с ютуба отдельным файлом. Бесплатный рингтон Tutorial on the Fast Gradient Sign Method for Adversarial Samples в формате MP3:

Если кнопки скачивания не

загрузились

НАЖМИТЕ ЗДЕСЬ или обновите страницу

Если возникают проблемы со скачиванием видео, пожалуйста напишите в поддержку по адресу внизу

страницы.

Спасибо за использование сервиса ClipSaver.ru

Tutorial on the Fast Gradient Sign Method for Adversarial Samples

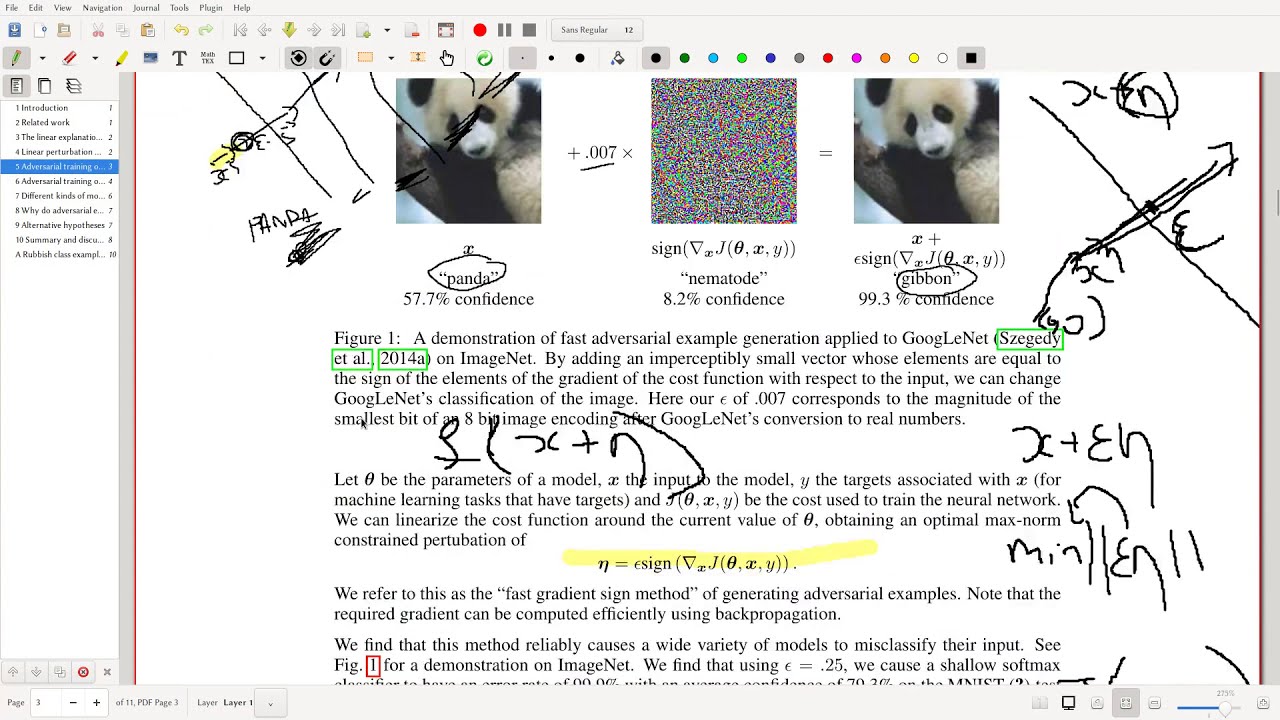

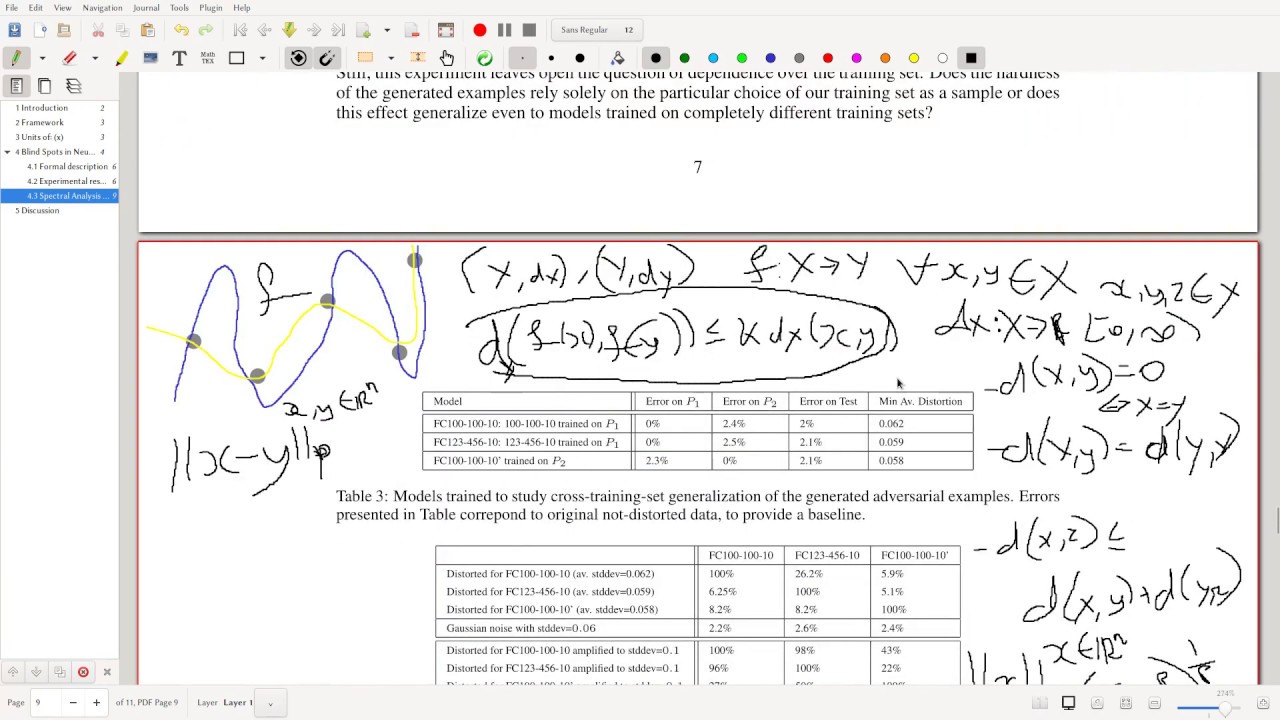

Today I go over the Fast Gradient Sign Method with the help of the Tensorflow notebook. Explaining and Harnessing Adversarial Examples video: • What are Adversarial Samples in Machine Le... Notebook: https://www.tensorflow.org/tutorials/... Paper: https://arxiv.org/abs/1412.6572

![[Attack AI in 5 mins] Adversarial ML #1. FGSM](https://imager.clipsaver.ru/4TseynD_v7M/max.jpg)